デイリーAIダイジェスト — 2026-05-08

arXiv ハイライト

Lightning Unified Video Editing via In-Context Sparse Attention

In-context learning(ICL)はビデオ編集のための統一的なフレームワークになりつつあります。すなわち、ソース動画と「コンテキスト」(例:編集済みの参照フレーム、指示条件付きの例示)を連結し、video diffusion transformerに一括入力するというものです。その代償として、トークン数が2倍になることによる二乗コストのattentionが生じます。本論文は、ソーストークンとコンテキストトークンの非対称性を利用した構造的スパース化スキームであるIn-context Sparse Attention(ISA)を提案し、これをWan 2.2をpost-trainingしたビデオエディタLIVEditorとして実装します。

設計を動機づける2つの経験的観察

著者らはICLのattention行列を4つのブロック、すなわち Q^{\text{src}}(K^{\text{src}})^\top、Q^{\text{src}}(K^{\text{ctx}})^\top、Q^{\text{ctx}}(K^{\text{src}})^\top、Q^{\text{ctx}}(K^{\text{ctx}})^\top に分解します。

ソース–ソースブロックが支配的であり、ソース–コンテキストとのギャップは深さとともに拡大します。これにより、均一なスパース化ではなくコンテキストのKeys/Valuesを積極的に刈り込むことが動機づけられます。第2の観察は理論的なものです。すなわち、softmax attentionの0次テイラー展開の誤差はQueryの分布の鋭さと相関しているということです。鋭いquery(peakedなattention)はスパース近似に耐えにくく、フラットなqueryは低コストで近似できます。

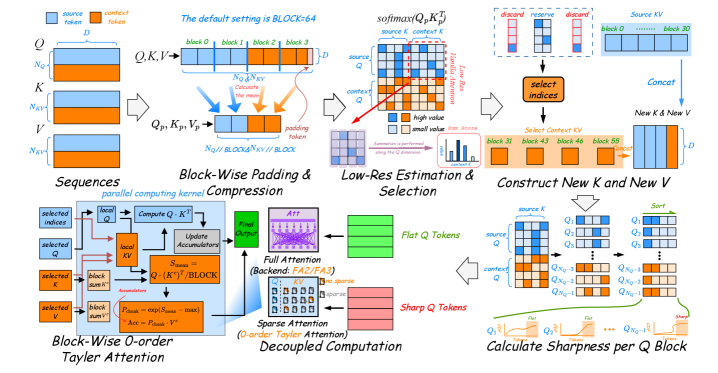

手法

ISAはブロックサイズ L_Q、L_K のブロック分割されたトークン上で動作し、シーケンス軸のpoolingによって圧縮表現 Q^c, K^c, V^c を得ます。パイプラインは3段階で構成されます。

1. コンテキスト事前選択。 粗いスコア行列 S_{\text{coarse}}\in\mathbb{R}^{B\times H\times N_Q\times N_K} から、ソースquery × コンテキストkeyエントリに対応するスライス S^{\text{ctx}}_{\text{coarse}} を取り出し、ソースquery軸に沿って平均化した後、Top-k 選択を行います。

I_{\text{topk}} = \text{TopK}(\text{Mean}(S^{\text{ctx}}_{\text{coarse}}, \text{axis}=2), \text{axis}=2).

保持されたコンテキストKVブロックは収集され、完全なソースKVと連結されます。

K_{\text{new}} = [K^{\text{src}}; \text{Gather}(K^{\text{ctx}}, I_{\text{topk}})], \quad V_{\text{new}} = [V^{\text{src}}; \text{Gather}(V^{\text{ctx}}, I_{\text{topk}})].

ハイパーパラメータ \alpha_s(デフォルト値0.125)は保持するコンテキストブロックの割合を制御します。すなわち、attentionが計算される前にコンテキストKVの87.5%が除去されます。

2. ブロック単位の0次テイラースパースattention。 低い鋭さのqueryブロックに対して、ISAはsoftmax attentionをブロック平均の参照点周りの0次テイラー近似で置き換えます。これは著者らが専用のスパースカーネルとして実装した低コストな線形集約に帰着します。近似誤差はqueryブロックの鋭さによって上界が与えられます。証明は付録に掲載されていますが、要点はフラットなqueryは実質的に計算コストなしに処理できるということです。

3. 動的queryグルーピング。 各queryブロックについて、粗いスコアから鋭さを計算し、高い鋭さを持つブロック(割合 \alpha_f=0.5)は完全なFlashAttention-2にルーティングされ、残りは0次テイラーカーネルに送られます。第2の比率 \alpha_{ns}=0.0625 が非鋭グループのKVスパース性をさらに制御します。これにより2つの実行パスが生成され、その総コストはスパースカーネルに支配され、選択およびgather操作によるオーバーヘッドは無視できる程度です。

LIVEditorとデータ

LIVEditorは、Wan 2.2の高ノイズブランチを厳選された170万サンプルのデータセットでpost-trainingすることで構築されています。パイプラインはキャプションと指示の合成にGemini 2.5 Flashを使用し、編集済みの初期フレームのレンダリングにGemini 2.5 Image Previewを使用し、人物にはpose-guided TI2V、非人物被写体にはattention injectionを用いて編集を時間的に伝播させます。公開ソース(Ditto、LoVoRA、ReCo)が非人物部分を補完します。学習は2段階で行われます。まずlr 1e{-5} で170万サンプル、次にlr 1e{-6} で8.9万の高品質サンプルを使用し、いずれもバッチサイズ16でZeRO-3 Offloadを適用します。合成フレームをコンテキスト、実フレームをソースとする一貫したロール割り当てにより、合成データからのアーティファクトの漏洩を軽減します。

結果

LIVEditorはEditVerseBench、IVE-Bench、VIE-Benchにおいて従来の最先端手法を上回ります。効率性に関する主な主張は、密なattentionと比較してattentionモジュールのレイテンシを約60%削減するというものであり、図2ではSDPAおよびFA2に対するスピードアップがシーケンス長とともに単調に拡大することが示されています。これはトークン数が2倍になるICL編集において重要なレジームです。EditVerseBenchおよびFiVE-Benchでのアブレーション実験により、選択された (\alpha_s, \alpha_{ns}, \alpha_f) = (0.125, 0.0625, 0.5) においてISAは完全なattentionと同等以上の品質を達成することが示されており、通常の品質–スパース性のトレードオフに反した結果となっています。これはコンテキストトークンが大部分において冗長であるという著者らの主張を支持するものです。

制限とオープンな課題

事前選択は、コンテキストトークンがソーストークンよりも系統的に重要度が低いことを前提としています。これはICL編集では検証されていますが、コンテキストがソースフレームにはない細粒度の空間情報を担うタスク(例:長距離のアイデンティティ参照、マルチショットの一貫性)では成立しない可能性が高いです。鋭さに基づくルーターは閾値ではなく固定比率を使用しているため、シーンの複雑さの変化への適応は粗いものになります。0次テイラー近似の誤差上界は鋭さに依存していますが、データ分布には依存していないため、学習レジームを外れると完全なattentionとの経験的な等価性が低下する可能性があります。最後に、報告されている改善はattentionモジュールのレイテンシに関するものであり、エンドツーエンドのdiffusionサンプリングのレイテンシ削減は、選択した解像度においてattentionがスケジュール全体をどの程度支配しているかに依存します。

なぜこれが重要か

ICLは制御可能なビデオ編集のデフォルトインターフェースになりつつありますが、すでに計算コストの高いvideo DiTの上にattentionコストを2倍にしてしまいます。ISAは、ソース/コンテキストの非対称性が単に経験的にではなく、構造的に利用可能であることを示しています。そして、KV側の事前選択とquery側の鋭さルーティングを組み合わせることで、このレジームに対して適切な形の最適化であるロスレスに近い60%のattentionスピードアップが得られることを示しています。

Source: https://arxiv.org/abs/2605.04569

Stream-R1: Reliability-Perplexity Aware Reward Distillation for Streaming Video Generation

問題設定

Distribution Matching Distillation(DMD)は、自己回帰型ストリーミング映像拡散モデルを少ステップの student モデルに圧縮するための主力手法ですが、標準的な目的関数はすべてのロールアウト、すべてのフレーム、すべてのピクセルを等しく情報量のある教師信号として扱います。著者らは、この一様な重み付けが二つの独立した決定を混同していると主張しています。すなわち、ある student のロールアウトから学習すること自体が妥当か否か、そしてそのロールアウト内のどこに gradient を集中させるべきか、という二点です。両軸には実質的な分散があります。一部の student サンプルは単純に信頼性が低く(teacher と student のスコアギャップがノイズを含んでいたり誤解を招いたりする)、信頼性の高いサンプルの中でも perplexity は特定の領域やフレーム(動き境界、自己回帰ロールアウトにおける後半フレームなど)に集中しています。エラーが累積する長期間のストリーミング生成において、この構造を無視すると蒸留済み student モデルで達成可能な品質に上限が生じます。

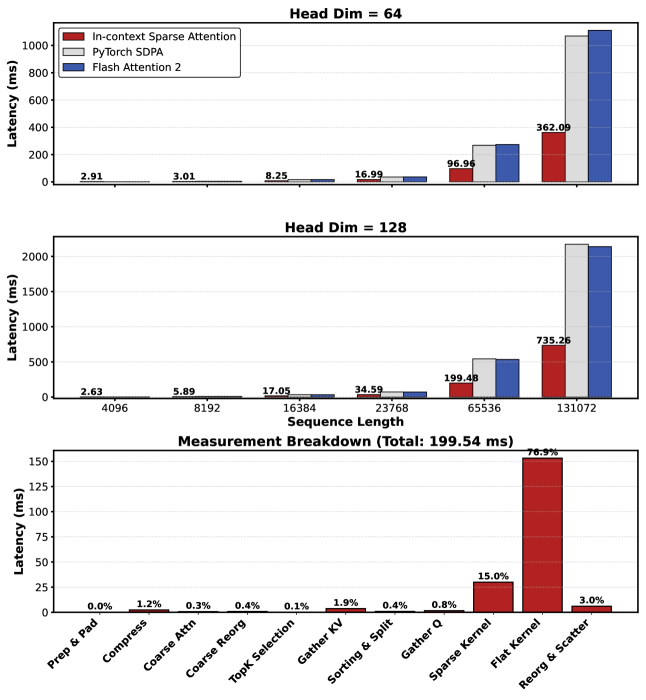

手法

Stream-R1 は Reward Forcing をベースに構築されており、student として Wan2.1-T2V-1.3B、teacher として Wan2.1-T2V-14B を使用し、832\times 480 の解像度で 5 秒の映像を生成します。基本となる DMD の gradient は標準的なスコア差

\mathbf{g} = f_{\text{fake}}(\mathbf{x}_t, c) - f_{\text{real}}(\mathbf{x}_t, c),

であり、loss は \mathcal{L}_{\text{DMD}} = \tfrac{1}{2}\|\mathbf{x}_0 - \text{sg}(\mathbf{x}_0 - \hat{\mathbf{g}})\|^2 です。Stream-R1 はこれを以下のように再構成します。

\mathcal{L}_{\text{Stream-R1}} = \mathbf{W}_{\text{inter}} \cdot (\mathbf{W}_{\text{intra}} \odot \mathcal{L}_{\text{DMD}}),

ここで単一の共有 reward モデルが両方の重みを生成します。

パイプラインは四つのコンポーネントで構成されています。

Inter-Reliability スコアの抽出。 事前学習済みの reward モデルが fake ロールアウトを三つの軸——視覚品質(VQ)、動き品質(MQ)、テキスト整合性(TA)——に沿って評価し、スカラー R_{\text{score}} を出力します(“Overall” モードでは三者を平均します)。inter-rollout の重みは指数的なリスケーリング w_{\text{inter}} \propto \exp(\beta R_{\text{score}})(逆温度 \beta = 2.0)で与えられます。高 reward なロールアウトが gradient を支配し、信頼性の低いものは破棄されず下方重み付けされます。

適応的 gradient サリアンシの結合。 各軸について、reward のピクセルレベル latent に対する gradient がサリアンシマップ s_{\text{VQ}}, s_{\text{MQ}}, s_{\text{TA}} を与えます。これらは適応的(温度 \tau = 1.0)に融合され、reward の感度が最も高い時空間位置——すなわち loss の低減が知覚品質の向上に最も直結する位置——を強調した統合サリアンシが得られます。

時空間分解。 統合マップはフロア \sigma_{\min} = 0.15、\tau_{\min} = 0.20 を設けた分離可能な空間・時間方向の重みベクトルに因子分解されます。このフロアは、reward モデルがたまたま無視する領域やフレームが完全にゼロになることを防ぎ、それによって生じる表現のドリフトを抑制します。その積が \mathbf{W}_{\text{intra}} を形成します。

バランスの取れた多次元 reward により、VQ・MQ・TA のいずれかがサリアンシ融合を支配しないことが保証されます。

学習は 8×A100 上で 1,000 オプティマイザステップ、effective batch 64 で実施され、G_\theta に AdamW(2.0\times 10^{-6})、f_{\text{fake}} に AdamW(4.0\times 10^{-7})を使用し、generator は 5 ステップごとに更新、ステップ 200 から EMA decay 0.99 を適用します。デノイジングはタイムステップ [1000, 750, 500, 250] での 4 ステップで行われ、3 フレームの latent チャンクに対してチャンクド attention ウィンドウ 9 を使用します。総壁時計時間は約 56 時間です。

結果

Reward Forcing baseline との定性的比較では、baseline が動きのアーティファクトやテクスチャの劣化を蓄積するのに対し、Stream-R1 はチャンク間で鮮明な構造とコヒーレントな動きを維持しており、長い自己回帰ロールアウトで最も顕著な改善が見られます。

提供されたセクションには定量的なテーブルは含まれていませんが、構成は完全に明示されています。inter-reliability の鋭さを制御する \beta = 2.0、サリアンシ融合の \tau = 1.0、そして focused な最適化とカバレッジのトレードオフを制御するフロア (\sigma_{\min}, \tau_{\min}) = (0.15, 0.20) が主要なハイパーパラメータです。二つの独立して学習されたモジュレータではなく単一の reward モデルが両方の重みを生成するという点が、主要なエルゴノミクス上の主張です。ロールアウトの採用を制御するスカラー R_{\text{score}} が、gradient を通じて時空間マスクも生成します。

制限と未解決の問題

本フレームワークは reward モデルのバイアスを引き継ぎます。VQ/MQ/TA モデルが特定の動きパターンに対して低い reward を与える場合、それらの領域は系統的に小さな gradient を受け取ることになり、空間・時間フロアはこの問題を部分的にしか緩和できません。\beta = 2.0 での指数的リウェイティングは積極的すぎる可能性があり、w_{\text{inter}} リスケーリング後の effective batch size が少数の高 reward ロールアウトに収縮する可能性があり、これは強化学習における importance sampling の分散問題に類似しています。空間×時間の分離可能な因子分解は強い仮定であり、空間と時間で同時に局所化されるサリアンシ(例えば動く物体)を表現できません。選択されたセクションでは VBench やユーザースタディの数値も報告されていないため、Reward Forcing や CausVid に対する改善の大きさはここでは定量化されていません。最後に、本手法は 1.3B student / 14B teacher スケールの 5 秒クリップのみで実証されており、reliability-perplexity 分解がより長い時間軸やより大きな student に対して成立するかどうかは未解決のままです。

重要性

Stream-R1 は DMD 蒸留をクレジット割り当ての二段階問題として再定式化し、単一の reward モデルがどのロールアウトを信頼すべきかをゲーティングしつつ、その内部のどこに gradient を押し込むべきかを同時に決定できることを示しています。これは reward ガイド付き蒸留のクリーンな一般化であり、サンプル間およびサンプル内で教師信号の品質が変動する他の生成的蒸留レジームにも移転可能なはずです。

Source: https://arxiv.org/abs/2605.03849

Stream-T1: ストリーミング動画生成のためのTest-Time Scaling

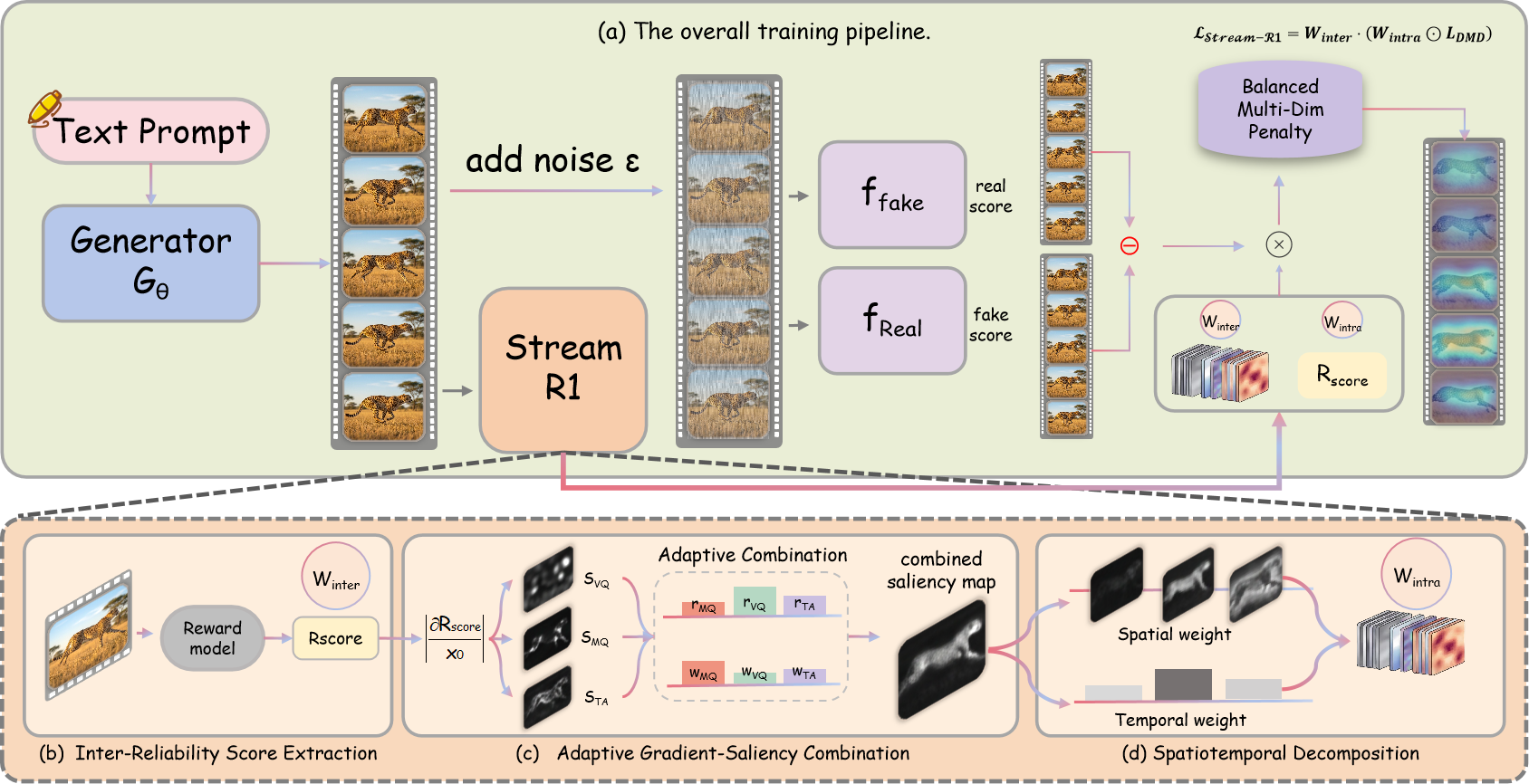

動画生成におけるtest-time scaling (TTS)はこれまで、diffusionモデルのテンプレートを継承してきました。すなわち、多数の完全な軌跡候補をサンプリングし、reward modelでスコアリングして最良のものを選ぶという手法です。動画に対しては、これは二重に高コストです。各候補は多フレームにわたる完全なdenoisingの軌跡であり、かつrewardシグナルは動画全体が生成されて初めて得られるため、生成中に時間的なガイダンスが提供されません。Stream-T1は、TTSをストリーミング(チャンク自己回帰)動画diffusionを軸に再設計します。このモデルでは、生成がすでに少数ステップでdenoisingされる短いチャンクに分解されています。この分解こそがTTSを実行可能にする鍵です。探索は動画全体ではなくチャンク単位で行えるようになり、rewardフィードバックをチャンク間に注入できます。

セットアップ

ベースモデルはLongLive(Wan2.1-T2V-1.3Bをベースに構築)であり、結合分布を以下のように分解します。

p_\theta(x^{1:N}\mid c) = \prod_{i=1}^{N} p_\theta(x^i \mid x^{<i}, c),

各条件付き分布は、チャンクのlatentに対する少数ステップのdenoisingモジュール G_\theta によって実現されます。KV-cacheはattentionウィンドウ9チャンクとsink 3チャンクを使用します。Stream-T1はこれをチャンク単位のbeam searchでラップし、すべてのチャンク境界において3つのコンポーネントを有効化します。

Stream-Scaled Noise Propagation

標準的なストリーミング生成では、各チャンクのlatentノイズを \mathcal{N}(0,I) からi.i.d.で初期化し、どのノイズシードが高rewardの継続を生んだかに関する事前情報を破棄します。Stream-T1の第1ステージでは、チャンク n のノイズサンプリングを、チャンク n{-}1 から生き残った(高rewardの)候補のノイズ軌跡に条件付けます。この動機は、ストリーミングモデルの少数ステップのdenoising体制において、初期ノイズが単なる不要な変数とはほど遠く、チャンク境界を超えたモーションの連続性とアイデンティティ保持を実質的に形成するという点にあります。i.i.d.で再サンプリングする代わりに「歴史的に実証済みの」Gaussian事前分布を伝播させることで、探索はノイズ空間における明示的な時間的依存性を確立し、すでに一貫したダイナミクスを生み出した軌跡への探索をバイアスします。

Stream-Scaled Reward Pruning

各チャンクが完全にdenoisingされた後、候補はLong-Short Combined Rewardによってスコアリングされます。このrewardはローカルな美的品質とグローバルな一貫性の両方を対象とします。

- 短系列(フレーム/チャンクレベル)reward:HPSv3、ImageReward、MHPなどのimage rewardモデルが空間的な美的品質と視覚的忠実度を評価します。

- 長系列reward:VisionReward、VideoAlign、VideoLLaMA3などのvideo rewardモデルが、10チャンクのスライディングウィンドウにわたって適用され、時間的一貫性とグローバルなダイナミクスをスコアリングします。

最適でないブランチはプルーニングされ、生き残ったビームのノイズとKV-cacheの状態だけが次のチャンクに伝播します。二段階のrewardは、純粋なフレームレベルのスコアリングで知られる失敗モード(局所的には美しいが時間的に非一貫)に対処しつつ、長距離スコアラーのコンテキストをスライディングウィンドウで制限します。

Stream-Scaled Memory Sinking

第3ステージはKV-cacheの退避ポリシーを対象とします。ウィンドウ9・sink 3という設定において、単純なFIFO退避は、主体のアイデンティティやシーンのレイアウトといった重要な長期的意味論を担うコンテキストを破棄してしまいます。Stream-T1は、意味的境界検出に基づいて退避されたコンテキストを異なる更新パスにルーティングし、そのルーティング決定はそのコンテキストが由来するチャンクのrewardスコアによって調節されます。具体的には、高rewardで意味的なアンカーとなるコンテキストはsinkに保持され、一過性のコンテキストは通常通り退避されます。これにより、探索シグナルがプルーニングで止まるのではなく、モデルの長期記憶にフィードバックされます。

結果

本論文では、832×480、16 FPS、seed 42における LongLive/Wan2.1-T2V-1.3B での実験が報告されており、Causvid、Self-Forcing、LongLiveとの比較評価が行われています。定性的な比較(図3)では、ストリーミングベースラインと比較して、Stream-T1がフレームごとの忠実度とチャンク間の時間的一貫性の両方を改善していることが示されています。abstractでは両軸にわたって大幅な改善があると説明されていますが、提供されたセクションには具体的な集約メトリクスの数値は含まれていません。

制限と未解決の問題

- 提供されたセクションではフレームワークと定性的な挙動が説明されていますが、VBenchスタイルの定量的スコアやベースラインのLongLiveに対する計算コストのオーバーヘッドは列挙されていません。チャンク単位のbeam searchは推論コストをビーム幅の倍数に増加させますが、実際のwall-clock上のトレードオフはここでは特定されていません。

- Long-Short Combined Rewardは、異種のrewardモデル(HPSv3、VisionReward、VideoAlign、VideoLLaMA3)のキャリブレーションに依存しており、reward hackingとモデル間の不一致は分析されていません。

- Noise propagationは、チャンク n{-}1 の最適なノイズがチャンク n に対して有益であることを前提としています。ハードなシーンカットやpromptの切り替え時には、この事前分布が逆効果になる可能性があります。memory-sinkingモジュールの意味的境界検出器が暗黙のセーフガードとなっていますが、その頑健性は特徴付けられていません。

- 本手法は少数ステップのストリーミングdiffusionに依存しており、denoising ステップ数が増加した場合(初期ノイズの重要性が低下する場合)にもnoise propagationの効果が維持されるかどうかは未解決です。

なぜこれが重要か

ストリーミング動画diffusionはすでに構造的なコスト、すなわちチャンク化された自己回帰を伴っており、diffusionベースのTTSはこれを障害として扱っていました。Stream-T1はこれを逆転させます。チャンク化された少数ステップの生成は、まさにrewardフィードバックを用いたステップごとのbeam searchが実行可能であり、かつ初期ノイズの選択が十分なシグナルを持つため探索する価値がある体制です。これは、TTSとモノリシックな動画diffusionへの候補探索の後付けよりも、基盤となる生成プロセスとTTSのより誠実な適合です。

Source: https://arxiv.org/abs/2605.04461

RLDX-1 テクニカルレポート

RLDX-1 は巧緻操作を対象とした Vision-Language-Action (VLA) モデルであり、Multi-Stream Action Transformer (MSAT) を中核に構築されています。MSAT は、モダリティ固有のストリームとクロスモーダル self-attention の結合によって、ロボットの異種モダリティ(視覚、言語、固有受容感覚、トルク、触覚)を融合します。本研究は、現在の最先端 VLA(例:\pi_{0.5}、GR00T N1.6)が事前学習済み VLM から強力なシーン理解を継承している一方で、現実世界の巧緻タスクに必要な以下の三つの具体的な能力を欠いていると主張しています:フレーム間の動作認識、長い時間軸にわたるメモリを考慮した意思決定、そして物理センシング(力覚・触覚)。RLDX-1 は、アーキテクチャ、データ合成、多段階学習、および推論グラフ最適化を組み合わせたシステムレベルの回答です。

アーキテクチャ

バックボーンは Qwen3-VL 8B から派生した時間認識 VLM です。身体的なグラウンディングの欠如に対処するため、著者らはロボット固有の VQA コーパス上でこれを fine-tuning しており、そのコーパスは三つのスライスから成ります:(i) エンドエフェクターと物体の空間的関係、(ii) 中間サブタスクのラベル、(iii) 低レベルの動作ディスクリプタ。GR00T スタイルの慣行に従い、行動関連の特徴は最終層ではなく中間の transformer 層から抽出されます。これは後段の層が言語生成に特化するためです。少数の学習済み cognition token が VLM の状態をコンパクトな表現に要約し、それが action モデルへと渡されます。

action モデル自体は MSAT(図3)です:各モダリティ(視覚・言語 cognition、固有受容感覚、動作特徴、memory token、物理ストリームのトルク・触覚)はモダリティ固有の射影を伴う独自のトークンストリームを持ち、すべてのストリームが共有 self-attention 層を通じて同時に attend し、action チャンクは flow matching によってデコードされます。Motion Module は動作認識のためのマルチフレーム時間的コンテキストを提供し、Memory Module は長期的推論のために過去の観測の圧縮表現を保持し、Physics Stream は関節トルクおよび指先触覚信号を取り込みます。

学習データと手順

事前学習では、単腕グリッパー、双腕グリッパー、ヒューマノイド巧緻ハンドにわたる約150万エピソードが使用されます:Open-X-Embodiment(87万件)、DROID(9.2万件)、Galaxea Open-World(11.4万件)、AgiBot World G/H(23.9万件 / 3.6万件)、Fourier ActionNet(3万件)、Humanoid Everyday(9千件)、さらに稀な操作シナリオを対象とした自社パイプラインで生成された15万件の合成 GR-1 ヒューマノイドエピソードです。視覚の前処理には Qwen3-VL のネイティブ解像度エンコーダを活用し、アスペクト比を保ちながらフレームあたりの vision token を 64\times 64 に制限しています。

学習は三段階で進行します:(1) 身体非依存の action prior を学習するためのマルチ身体混合データによる flow-matching 事前学習;(2) Memory モジュールおよび Physics モジュールを導入し、ALLEX ヒューマノイドおよび触覚拡張 Franka Research 3(FR3)上でエキスパートスキルを発展させる身体固有の中間学習;(3) 個別ベンチマークで SOTA を達成するためのタスク固有の事後学習。Flow-matching の目的関数は、ガウスノイズと目標 action チャンクの間の補間 a_t = (1-t)\epsilon + t\, a に沿った速度場 v_\theta(a_t, t \mid o) を予測します。

推論の最適化

動的なシーンにおいてクローズドループ制御はレイテンシによって性能が劣化するため、著者らは二層の最適化を通じて推論を高速化しています。グラフレベルでは、PyTorch eager と torch.compile の両方がフォワードパスを複数の CUDA Graph サブグラフに分割し、残留するカーネル起動オーバーヘッドが 8B-VLM ベースのポリシーの実行時間を支配しています。彼らはモデルを単一の静的グラフに変換することで、フォワードパス全体を一つの CUDA Graph としてキャプチャし、エンドツーエンドで起動オーバーヘッドを排除しています。さらにカーネルレベルの最適化(セクション 5.2)によりカーネル内の非効率性を低減しています。

結果

本論文は、RLDX-1 がシミュレーションベンチマーク(セクション 6.1)および現実世界の OpenArm ヒューマノイドベンチマーク(セクション 6.2)において、\pi_{0}-FAST、\pi_{0}、\pi_{0.5}、GR00T N1.5、GR00T N1.6 を「一貫して上回る」と主張しています。中間学習済みの variant は、動作認識、長期記憶、物理センシングを特に必要とする ALLEX および FR3 タスクで評価されています(セクション 6.3–6.4)。アブレーション(セクション 6.5)は、クロスアテンション融合に対する MSAT の寄与、事後学習段階、および静的グラフ推論パスの貢献を個別に分析しています。提供されている抜粋にはベースラインとデータセット表が記載されていますが、数値の主要スコアは含まれていません。アブストラクトの主張は定性的(「一貫して上回る」)であるため、具体的な勝利マージンはセクション 6 の完全な表から読み取る必要があります。

限界とオープンクエスチョン

いくつかの問題点が見受けられます。第一に、arxiv の ID とメタデータが、Qwen3-VL、GR00T N1.6、\pi_{0.5} を引用する 2025 年代のテクニカルレポートと一致していないように見えます——読者はこれを査読済みの結果ではなくシステムレポートとして扱うべきです。第二に、合成データパイプラインはヒューマノイド GR-1 に特化したもの(15万エピソード)であり、他の巧緻プラットフォームへの転移については評価されていません。第三に、静的グラフへの変換は固定された入力形状を前提としており、デプロイ時に可変長の memory や可変フレームの Motion Module 入力を制約します。第四に、触覚・トルクストリームがノイズを含む場合や部分的に欠損している場合(FR3 スタイルの後付け改造において現実的な状況)の故障モードについて言及がありません。最後に、マルチストリームの joint-attention 設計は GR00T N1.5/1.6 が採用するクロスアテンション adapter よりもパラメータ数および計算量が多く、同じ推論予算での比較においてそれらのベースラインに対するレイテンシと性能のトレードオフが抜粋中では報告されていません。

なぜ重要か

RLDX-1 は、汎用巧緻操作へのギャップを埋めるには視覚言語スタックを単にスケールするのではなく、VLA バックボーンに明示的な動作・メモリ・物理センシングの経路を付加する必要があるという命題の具体的な実例です。静的グラフによる CUDA Graph 推論のレシピは、クローズドループ制御に 8B クラスの VLM ポリシーをデプロイする場合に汎用的に有用です。

Source: https://arxiv.org/abs/2605.03269

OpenSearch-VL: フロンティアマルチモーダル検索エージェントのオープンレシピ

問題

マルチモーダル「ディープサーチ」エージェント — 推論と画像検索・テキスト検索・OCR・クロッピング・その他の視覚ツールをインターリーブして、知識集約型の視覚的質問に回答するVLM — は、ベンチマークのフロンティア(BrowseComp-VL、MMSearch、LiveVQA、InfoSeek)となっています。最強のシステム(GPT-5、Gemini-2.5-Pro)はクローズドのままであり、これまでのオープンな取り組みは2つの構造的なデータ問題に悩まされていました:(i) ベースVLMが1回のフォワードパスで解けてしまうプロンプトによってone-step retrieval collapseが生じる問題、および (ii) 答えのエンティティ名が質問中に現れるショートカット漏洩によって、マルチホップのツール使用が無意味になる問題です。OpenSearch-VLは、データ構築・ツール環境・SFTコーパス(SearchVL-SFT-36k)・RLコーパス(SearchVL-RL-8k)・マルチターンRLアルゴリズムという完全なパイプラインを公開することで、これらの問題に対処しています。

データ構築

データパイプラインが最も新規性の高い部分です。

Wikipediaは記事をノード、記事内ハイパーリンクをエッジとした有向グラフ \mathcal{G}=(\mathcal{V},\mathcal{E}) として扱われます。長さ h\in\{2,3,4\} の制約付きランダムウォークにより、以下のパスが生成されます。

P = (v_0 \xrightarrow{\rho_1} v_1 \xrightarrow{\rho_2} \cdots \xrightarrow{\rho_h} v_h),

曖昧さ回避ページ・サイクル・入次数が \tau_{\text{hub}} を超えるハブノードはスキップされます。各ノードには機能的な役割が付与されます:v_0 は視覚的なアンカー(代表画像に基づく参照表現に置き換えられます)、v_1,\dots,v_{h-1} はブリッジエンティティ(名前がファジー化されます)、v_h は答えノードです。GPT-4oは v_h をクエリ対象の属性のみを通じて参照する標準質問 q_t を合成し、続いてファジー書き換え q_f によってエンティティ名のショートカットを除去しつつ答え a を固定します。視覚的アンカーを答えエンティティから意図的に分離することが、one-shot retrievalを排除する仕組みです。その後の段階的フィルタリングでは、ツールなしで解けるサンプルを除外し、さらにエンハンスメントパスによって画像を劣化させます(ブラー・低解像度・透視歪み)。これにより、シャープ化・超解像・透視補正などのツールが必要となり、think-with-imageの挙動が促進されます。軌跡は実際のツール環境で合成され、答えの正確性ジャッジとプロセスレベルのジャッジの両方を用いたリジェクションサンプリングによって、36,592件のSFT軌跡が得られます。8kのRLプールは同じVQAプールから非重複に抽出されます。

学習

SFTは各ステップのアクション a_l = [z_l, c_l](推論トレース+ツール呼び出し)を自己回帰的に分解します:

P_\theta(a_l \mid h_l) = P_\theta(z_l \mid h_l)\, P_\theta(c_l \mid h_l, z_l),

取得したツール観察 o_l はlossからマスクされます(Jin et al. 2025に従い)。これにより、モデルは自身の推論とアクションのみについて教師あり学習を行います。

RLステージでは、実ツール環境におけるマルチターンロールアウト上でGRPOを使用し、複合報酬 r = r_{\text{acc}} + r_{\text{query}} + r_{\text{fmt}}(最終回答の正確性・プロセスレベルのクエリ品質・フォーマットチェック)を適用します。アルゴリズム上の主要な貢献はfatal-aware token maskingです:軌跡がステップ k でfatal error(不正なツール呼び出し・同一クエリの繰り返し・環境障害)に達した場合、k 以降のトークンをマスクし、片側のadvantage clampingを適用することで、最終的にfatalとなる軌跡中の早期の有効な推論ステップがペナルティを受けないようにします。これは軌跡全体をハードマスクする手法とは対照的です。

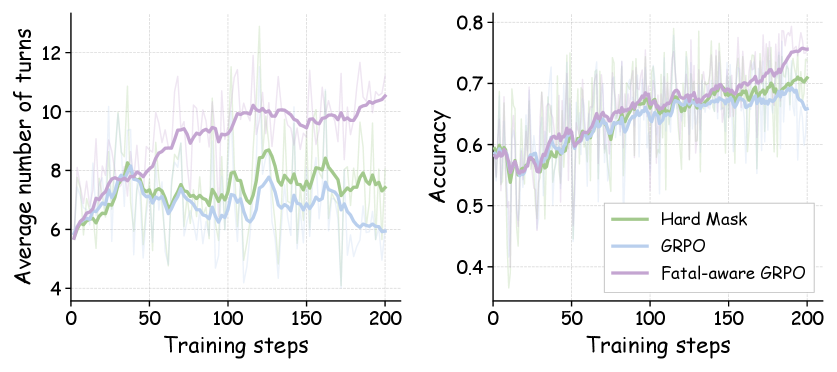

ダイナミクスのプロットは、バニラGRPOがfatalペナルティを避けるために早期終了を学習することで短いロールアウトに崩壊する(ターン数が減少する)のに対し、fatal-aware GRPOはより高いターン数を維持し、厳密により高いバッチ精度に達することを示しています。

結果

7つのベンチマーク(SimpleVQA、VDR、MMSearch、LiveVQA、BrowseComp-VL、FVQA、InfoSeek)において、GPT-4oジャッジによるPass@1として報告されています:

- 直接推論ベースライン:Qwen3-VL-32Bの平均は31.6、GPT-4oは29.5、GPT-5は45.1、Gemini-2.5-Proは46.0。

- RAG(シングルパス retrieval):GPT-5は53.6、Qwen3-VL-8Bは40.7に達します。

- オープンなエージェントベースライン:MMSearch-R1-7Bの平均は42.4、Visual-ARFT-7Bは28.8。

Qwen3-VL-8Bベースは、直接推論の平均22.3から、OpenSearch-VL学習後に大幅に高い数値へと向上しています(論文はフロンティアと競争できる平均を報告しており、例えば同レシピ下での8Bモデルはエージェントブロックにおいてもいe GPT-5/Gemini-2.5-Proと対抗する位置づけです)。特に注目すべき点として、BrowseComp-VL — GPT-4oが5.5、GPT-5 RAGでさえ54.9にとどまる最難関のマルチホップ視覚的ウェブ検索ベンチマーク — では、エージェントレシピによってベース24.1からのギャップの大半が埋まっています。直接推論のピークが9.8(GPT-5)であり、ほとんどのオープンエージェントが8を下回るVDRでは、段階的フィルタリングされたツール要求型の学習分布によって大幅に高い数値が達成されています。

限界と未解決の問題

- ジャッジはGPT-4oであり、それ自体が無視できない分散の源であり、ロングテールエンティティの正確性に対するソフトな上限となっています。

- 64台のH20上での200ステップのRLは短く、RLをさらにスケールアップした場合にBrowseComp-VLが継続的に向上するか飽和するかは未解決です。

- Wikipediaから派生したパスは英語百科事典的エンティティに偏っており、非Wikipediaのロングテールなビジュアルエンティティ(製品写真・科学的図版)に対する性能はストレステストされていません。

- Fatal-aware maskingは手動定義のfatal error分類に依存しており、学習による fatal 検出は未解決のままです。

- プロセスレベルの報酬 r_{\text{query}} はクエリ品質ジャッジに依存していますが、その較正については深いアブレーションが行われていません。

なぜ重要か

これは、データ合成パイプライン・36k+8kデータセット・ツール環境・SFTおよび機能するマルチターンRLアルゴリズムからなる最初のエンドツーエンドのオープンレシピです。これにより、7B〜30Bのオープンなマルチモーダルディープ検索においてGPT-5およびGemini-2.5-Proと競争できるエージェント領域へとVLMを引き上げます。Wikipediaグラフと機能的役割の組み合わせによる構築手法およびfatal-aware GRPOは、ツールを使用するVLMを学習させる誰もが直接再利用できるコンポーネントです。

Source: https://arxiv.org/abs/2605.05185

PhysForge: インタラクティブ仮想世界のための物理的根拠を持つ3Dアセット生成

問題

画像から3Dへの生成器のほとんどは、視覚的忠実度に最適化された静的なメッシュを生成しますが、物理シミュレータや embodied-AI 環境が必要とする構造的分解、マテリアル割り当て、ジョイント定義を欠いています。OmniPart のようなパート認識手法でさえ、ジオメトリ生成に留まり、その後のパイプラインにキネマティクスの手動作成を委ねています。PhysForge は、単一の画像から (i) パートごとにセグメント化されたジオメトリ、(ii) パートごとの物理的特性(マテリアル、質量、機能、アフォーダンス)、(iii) アーティキュレーションパラメータ(ジョイント種類、軸の原点、方向、制限)を同時生成することを目標とし、シミュレーション対応の URDF 形式のアセットを生成することを明示的な目的としています。

データセット:PhysDB

著者らは Objaverse をフィルタリングし、7つのカテゴリ(家庭用品、産業機器、武器、個人用品、乗り物、テクノロジー/電子機器、文化財)にわたって非自明なパート構造を持つ15万個のオブジェクトからPhysDBを構築しています。アノテーションは4階層に編成されています:

- Holistic:実世界スケール、カテゴリ、シーンコンテキスト。

- Static/semantic:パートごとの意味ラベル、マテリアル、質量。

- Functional:固有機能(例:「収納するため」)とOAKINK2に準拠した離散状態機械(例:ボタン:{押された、離された})。

- Interactive:原子的アフォーダンス(押せる、回転できる、など)、可動パートについては親リンケージとジョイント種類 ∈ {revolute, continuous, prismatic, fixed}。

VLM がレンダリングされたオブジェクト全体およびパートごとのビューから初期ラベルを生成し、人間がそれを修正します。PhysDBは任意のカテゴリに対して信頼性が低いと判断されたため、大規模な数値ジョイント軸のアノテーションを提供しておらず、アーティキュレーション監督としてPartNet-MobilityとInfinite-Mobilityを混合して使用しています。

手法

PhysForge は2段階の分離型パイプラインです。

Stage 1 — VLM Planner。 VLM が入力画像を取り込み、「階層的物理ブループリント」を出力します:バウンディングボックス、マテリアル、質量、機能、アフォーダンス、親インデックス、ジョイント種類を含むパートのツリー構造です。これは自由形式のキャプションではなく構造化された計画ステップであり、バウンディングボックスのレイアウトが Stage 2 への空間的条件付けとして機能し、離散的な物理フィールドがマテリアル/キネマティクスのヘッドを条件付けます。

Stage 2 — KineVoxel Injection を用いた物理的根拠を持つ Diffusion。 Diffusion model がブループリントを条件としてジオメトリとテクスチャのボクセル/潜在表現を生成します。その新規性は KineVoxel Injection (KVI) メカニズムにあり、キネマティクスの条件付け(ジョイント種類の embedding とパートボクセルに対する kinetics encoder)をデノイザーに統合することで、ジオメトリ生成とアーティキュレーションパラメータ回帰が特徴を共有します。「w/o joint type emb」および「w/o kinetics enc」という2つのアブレーション変種が、各KVIブランチの貢献を切り分けます。

このモデルはパートごとのジオメトリと連続的なジョイントパラメータ(軸方向、ピボット/原点、制限)を同時出力し、アセットをシミュレータへ直接エクスポート可能にします。

結果

パート構造計画(PartObjaverse-Tiny)。 BBox IoU、Voxel Recall、Voxel IoU を用いて、完全なPhysForgeが新たなSoTAを達成しています。情報量の多いアブレーションは行ごとに示されています:「PhysForge-bbox」(50万個のパートバウンディングボックスのみで学習、物理ラベルなし)は「PhysForge w/o mask」(物理条件付きあり、2Dマスクなし)より性能が低いです。物理条件付きモデルはマスク入力なしでも、SAMで生成したマスクを用いたOmniPartの第1段階を上回っています。これは、意味的/物理的ラベルが妥当なパート分解に対する強い事前知識として機能することを示しており、モデルは例えばケトルが蓋、注ぎ口、本体、ハンドルを持つことを、画像のセグメンテーションでそれが示されていなくても学習します。

アーティキュレートオブジェクト生成(Table 4、340個のPartNet-/Infinite-Mobilityオブジェクト)。 Articulate Anything、Singapo、URDFormerとの比較:

- Chamfer Distance:PhysForge 10.21 対 Singapo 21.10、Articulate Anything 23.31、URDFormer 25.42(約2倍低い)。

- CLIP-Sim:0.93 対 0.85–0.87。

- Joint-Axis-Err@5:0.101 対 Singapo 0.241、Articulate Anything 0.608。

- Joint-Pivot-Err@5:0.071 対 Singapo 0.153。

- Joint-Axis-Err-all / Pivot-all:0.164 / 0.096(Articulate Anything 0.694 / 0.197)。

アブレーションは KVI の両コンポーネントが重要であることを示しています:ジョイント種類の embedding を除去すると Joint-Axis-Err@5 が0.101から0.157に上昇し、kinetics encoder を除去すると0.158に上昇します。kinetics encoder の除去はピボット予測よりも軸予測に悪影響を与えており(axis-all 0.164 対 0.204)、これはエンコーダが軸方向推論に幾何学的文脈を提供していることと整合しています。

制限事項

- アーティキュレーション監督はPartNet-Mobility/Infinite-Mobilityに依存しており、これらは家具、家電、工具が中心です;武器、複雑なリンケージを持つ乗り物、あるいはソフト/多DoF機構への汎化は未検証です。

- PhysDBは数値ジョイント軸をアノテーションしていません — VLM プランナーはジョイント種類のみを出力するため、軸/ピボットの精度は diffusion 段階がより小規模なキュレートされたアーティキュレーションコーパスから何を推論できるかに完全に依存します。

- 報告されているメトリクスはジオメトリとキネマティクスに関するものであり、閉ループシミュレーション評価(例:接触安定性、操作成功率)は示されていません。

- 質量とマテリアル値はカテゴリ的/粗いものであり、物理測定に対するキャリブレーションは行われていません。

- 「w/o mask」アブレーションは強力ですが、ヘッドラインの数値はブループリントから導出されたバウンディングボックスによって恩恵を受けており、それ自体がVLMの品質に依存しています — Stage 1からStage 2へのエラー伝播は定量化されていません。

重要性

物理的な計画(VLMに適した離散的・意味的問題)と物理的な実現(diffusionに適した連続的なジオメトリ/キネマティクス問題)を分離することは、シミュレーション対応アセット合成に対するクリーンな因数分解であり、先行するアーティキュレーションパイプラインに対してCDが約2倍改善し、ジョイント軸誤差が半減したことは、この因数分解が効果的であることを示唆しています。PhysDBが公開された場合、4階層アノテーションスキーマは embodied-AI アセットデータセットの参照フォーマットとなる可能性があります。

Source: https://arxiv.org/abs/2605.05163

推論集約型検索の再考:エージェント的検索システムにおける Retriever の評価と改善

推論集約型検索は、表層的な語彙的・意味的類似性ではなく、下流の推論チェーンを支持する証拠を対象とする点で、トピック型検索とは本質的に異なります。本論文は、現行の実践——その代表例である BRIGHT——がこの区別を二つの側面で過小評価していると主張します。第一に、ベンチマークは各クエリを狭い正解セット——通常は元の回答が引用する単一のパッセージ——に固定しており、推論器が実際に必要とする補完的な証拠を無視しています。第二に、Retriever はシングルショットの「クエリ入力・パッセージ出力」体制で評価されていますが、本番のエージェント的システムは複数の言い換えクエリを発行し、ターンをまたいで冗長性のない証拠ポートフォリオを蓄積しなければなりません。著者らはこれらの両方のギャップを、新しいベンチマーク(BRIGHT-Pro)、新しい合成学習コーパス(RTriever-Synth)、および Qwen3-Embedding-4B を基盤とした fine-tuned エンコーダ(RTriever-4B)によって解決します。

BRIGHT-Pro:アスペクト分解された正解とエージェント的プロトコル

BRIGHT-Pro は、ドメイン専門家に各質問を複数の推論アスペクトに分解させ、アスペクトごとに正解パッセージにラベルを付けることで、BRIGHT クエリを再アノテーションします。クエリ q はアスペクトラベル付き正例の集合 \{(a_i, P_i)\} に関連付けられており、P_i はアスペクト a_i を充足するのに十分な空でないパッセージ集合です。評価は次の二つのプロトコルを採用します:

- Static:和集合 \bigcup_i P_i に対する標準的な nDCG/Recall に加え、top-k においてカバーされる異なる a_i の数を測定するアスペクトカバレッジ指標。

- Agentic:固定された検索エージェントが Retriever を通じて最大 T 個の言い換えクエリを発行し、ターンごとの結果をマージして累積アスペクトカバレッジと回答根拠の十分性で評価。

この分割により、著者らは単一正解ベンチマークが混同している二つの失敗モードを切り離すことができます:(i) 正規正解を高くランキングすること、および (ii) アスペクト横断的に多様な証拠を生成すること。推論に強い複数の Retriever は (i) では良好な結果を示しますが (ii) では性能が低下し、このギャップはエージェント的プロトコル下でさらに拡大します——冗長な top-k の挙動がターンを浪費するためです。

RTriever-Synth:アスペクト分解された合成学習データ

学習コーパスは、単一パッセージマッチングではなくポートフォリオ構築に報酬を与えるよう設計されています。シードクエリ q に対して、LLM はアスペクト分解 \{a_1,\dots,a_m\} を生成し、各 a_i に対して以下を生成します:

- 補完的正例 p_i^+:a_i に対する証拠を提供するが、他のアスペクトには貢献しないもの、

- 正例に条件付けられたハード負例 p_i^-:p_i^+ とトピック的に類似しており q に対してもっともらしく見えるが、いかなる a_i も前進させないもの。

学習にはマルチポジティブ InfoNCE を用いたコントラスティブ目的関数を使用します:

\mathcal{L}(q) = -\frac{1}{m}\sum_{i=1}^{m}\log\frac{\exp(s(q,p_i^+)/\tau)}{\sum_{j=1}^{m}\exp(s(q,p_j^+)/\tau) + \sum_{k}\exp(s(q,p_k^-)/\tau)},

ここで s はエンコーダ空間におけるコサイン類似度であり、分母はすべてのアスペクト正例(多様な top-k 構築時にバッチ内競合として扱われる)とハード負例をプールします。マッチする正例に条件付けてハード負例を生成するという設計選択が核心です。これにより、エンコーダはアスペクト関連テキストとアスペクト近傍テキストを広域トピック的特徴に頼ることなく識別するよう促されます。RTriever-4B は、このコーパス上での Qwen3-Embedding-4B の LoRA fine-tune として構築されています。

結果

BRIGHT-Pro、BRIGHT、および推論重視の複数の QA スイートにわたって、三つのパターンが浮かび上がります:

- アスペクトを考慮した static 評価はリーダーボードの順位を入れ替えます。標準的な nDCG@10 では強く見えるモデルが、アスペクトカバレッジでスコアリングされると地位を失います。アブストラクトは「アスペクト考慮評価とエージェント的評価が標準指標では隠れていた挙動を露わにする」と述べており、推論調整済みの複数の Retriever は、正規正解 nDCG でリードしながらもカバレッジでは汎用ベースラインに対して後退しています。

- RTriever-4B は、static およびエージェント的プロトコルの双方において BRIGHT-Pro 上でベースの Qwen3-Embedding-4B を大幅に上回り、LoRA のみの適応にもかかわらず、より大規模な推論集約型 Retriever と同等またはそれを超える性能を示します。

- エージェント的プロトコル下では、ターンをまたいで利得が積み重なります。補完的正例を用いた学習により連続検索での冗長性が低減されるため、累積アスペクトカバレッジは単一パッセージ関連性で学習した Retriever よりも速く飽和します。

限界と未解決の問題

このベンチマークは BRIGHT のドメインカバレッジを引き継いでおり、専門家によるアノテーションはクエリごとに依然として有限です。専門家が生成するアスペクト分解はそれ自体が不完全であり、カバレッジ指標に偏りをもたらす可能性があります。合成コーパスはアスペクトの分解とハード負例の生成の両方で LLM に依存しているため、蒸留アーティファクト(例えば p_i^- における文体的規則性)が保留内利得を過大評価させる可能性があります。エージェント的プロトコルは一つの検索エージェントを固定しており、クエリを異なる方法で書き換えたりツール呼び出しを交互に行うエージェントには結果が転用されない場合があります。最後に、本論文は多様性のために調整された遅延インタラクションモデルや学習済みスパースモデル(例えば MMR を考慮したリランキング)との直接比較を行っておらず、これらはポートフォリオ検索に対する自然なベースラインです。

なぜ重要か

Retriever がシングルショット QA ではなくエージェント的ループに奉仕するためには、学習と評価の双方をポートフォリオ指向にする必要があります。本研究は、具体的なベンチマーク、アスペクト条件付きハード負例を中心とした合成データのレシピ、および単一正解指標がエージェント的有用性について系統的に誤解を招くという証拠によって、その転換を実現します。

Source: https://arxiv.org/abs/2605.04018

Hacker News Signals

自然言語オートエンコーダー:Claudeの思考をテキストに変換する

Anthropicの投稿では、Claudeの内部chain-of-thought表現を自然言語にマッピングし直す手法を紹介しています。これは潜在的な推論状態に対するオートエンコーダーとして機能します。核心となるアイデアは、モデルの中間的な活性化(またはscratchpadのトークン列)をコンパクトな自然言語サマリーに圧縮するenconderを訓練し、そのサマリーから振る舞いを再構成できるdecoderを訓練するというものです。これは、スカラー特徴量を抽出する標準的な解釈可能性probeとは異なります。ここではボトルネック自体が自然言語であるため、潜在空間は構造的に人間が読めるものとなっています。

技術的な設定としては、自然言語の「思考サマリー」を生成するための二次モデルを訓練します。このサマリーをClaudeに与えることで、元の完全なchain-of-thoughtを与えた場合に近い忠実度で後続の出力が再現されます。Lossは、振る舞いの忠実度(元の思考と再構成された思考を与えた場合の出力分布間のKLまたはcross-entropy)と、可読性または圧縮の目的関数の組み合わせです。

動機は機構的なものです。自然言語サマリーが低い再構成誤差でモデルを往復できるならば、それはモデルが「実際に何をしていたか」の忠実で人間が解釈可能な説明を構成するということになります。これはアライメントと監視に直接的な関連があります。すなわち、数千ものattention weightではなく、サマリーを監査できるということです。

主な未解決の問題としては、サマリーが本当に因果的に関連する情報を捉えているのか、それとも単に出力と相関しているだけなのか、圧縮率が忠実度にどう影響するか、内部推論が表面のscratchpadから乖離するような敵対的なpromptingに対してサマリーが頑健かどうか、などが挙げられます。このアプローチはまた、二次的なencoder-decoderの品質に大きく依存しており、解釈可能性が未解決である第二のモデルを導入することになります。それでも、activation patchingやprobing classifierのスケーラブルな代替手法として、extended-contextな推論の解読可能な監視に向けた実践的な一歩を示すものです。

Source: https://www.anthropic.com/research/natural-language-autoencoders

Gemma 4の高速化:Multi-Token Prediction Drafterによる推論加速

Googleの投稿では、Gemma 4においてmulti-token prediction(MTP)drafterを統合し、speculative decodingによって推論を高速化する手法が詳述されています。標準的なspeculative decodingの構成では、小規模なdraftモデルが k 個のトークンを提案し、ターゲットモデルが1回のforward passでそれを検証します。受理されたトークンにより、ターゲットモデルの呼び出し回数を実質的に削減できます。Gemma 4のアプローチでは、独立したdraftモデルではなく、メインモデルと共同学習される補助的な出力ヘッドである軽量なMTP headを使用することで、2つの異なるチェックポイントを管理するという運用上の複雑さを回避しています。

MTP headは、同一の隠れ状態から複数の将来トークンを同時予測するよう学習されます。推論時には、メインモデルの最終隠れ状態がMTP headに入力され、長さ k(通常4〜8トークン)のdraft継続が生成されます。その後、ベースモデルが1回の並列forward passで k 個すべてを検証します。受理率および実際のwall-clock高速化の程度は、MTP headの分布がベースモデルの分布にどれだけ一致しているかに依存します。Googleは、受理率が高いコード生成などの準決定論的タスクにおいて、特に顕著なスループット向上を報告しています。

技術的には、MTP headのパラメータオーバーヘッドは最小限であり、モデルの隠れ表現を再利用し、追加トークン位置ごとに小規模なprojectionを加えるだけです。学習には将来トークン位置にわたって合計された重み付き補助lossが使用されます。これは先行研究(例:MetaのMTPの論文)において、より豊富な監督信号の副次的効果としてメインタスクのperplexityをわずかに改善することが示されています。

実用上の利点としては、シングルチェックポイントでのデプロイメント、draftモデルのレイテンシミスマッチの問題がないこと、既存のKV-cache管理との簡潔な統合が挙げられます。制限事項としては、MTP headが独立して学習された小規模モデルと比べてdraftの多様性が低いこと、また高temperature設定や創造的生成では受理率が低下し高速化の効果が急激に劣化することが挙げられます。このアプローチは出力が制約された設定において最も効果的です。

Source: https://blog.google/innovation-and-ai/technology/developers-tools/multi-token-prediction-gemma-4/

拡散モデルの積分を学習する

Sander Dieleman の記事では、flow map の学習というアイデアが展開されています。これは、時刻 t_0 のノイズから時刻 t_1 のクリーンなデータへの直接的なマッピングであり、反復的なステップ処理を回避しながらノイズ除去のトラジェクトリ全体を積分するものです。標準的な diffusion/flow-matching モデルは瞬時速度場 v_\theta(x, t) を学習しており、推論時には多くのステップにわたる数値的な ODE 積分が必要となります。ここでの洞察は、積分 \Phi(x_{t_0}, t_0, t_1) = x_{t_0} + \int_{t_0}^{t_1} v_\theta(x_t, t)\, dt 自体をニューラルネットワークとして直接パラメータ化し学習できるという点です。

flow map F_\theta(x_s, s, t) は、consistency 制約 F_\theta(x_s, s, t) = F_\theta(F_\theta(x_s, s, r), r, t)(s < r < t のすべての値に対して)を満たすよう学習されます。これは consistency モデルにおける自己整合条件に類似しています。この手法は consistency distillation と関連していますが、異なるものでもあります。ここでは、任意の t から t=0 へのマッピングではなく、任意の時間区間にわたるマップを学習します。

学習には、多ステップ ODE 解に対する回帰(distillation)と自己整合性 loss の組み合わせが使用されます。主な困難は、長い区間の flow map に対するターゲット自体が、より短い区間のマップを合成することで計算される必要があり、TD 学習に類似したブートストラップ問題が生じることです。この記事では、stop-gradient と段階的な区間拡張によってこれを安定化する方法が議論されています。

実用上の利点は、標準的な consistency モデルが達成するよりも多ステスト ODE ソルバーの品質に近い、1ステップまたは少数ステップの生成が可能になることです。これは、モデルが局所的な速度補正ではなく、グローバルに整合したトラジェクトリの積分を学習するためです。未解決の問題としては、スケーリング挙動、学習中に高コストな ODE のロールアウトなしに consistency 制約を課せるかどうか、および neural PDE 文献における学習済み ODE ソルバーとの関連性などが挙げられます。

Source: https://sander.ai/2026/05/06/flow-maps.html

ProgramBench: 言語モデルはゼロからプログラムを再構築できるか?

ProgramBench は、LLM がプログラムの動作に関する自然言語記述から完全かつ実行可能なプログラムを再構築できるかどうかを問うbenchmarkであり、スニペット補完ではなく深いプログラム理解の尺度として位置付けられています。核心となるタスクは、仕様(docstring、入出力例、あるいはその両方)を与えられた状態で、非公開のテストスイートを通過する完全なプログラムを生成することです。問題は、アルゴリズム的課題、データ構造の操作、システムレベルのロジックにわたり、難易度もさまざまです。

このbenchmarkの方法論的な貢献は、動作仕様(プログラムが何をするか)と構造的ヒント(それをどのように行うか)を区別した点にあります。HumanEval や MBPP などの従来のコーディングbenchmarkでは、しばしばdocstringに構造的な手がかりが含まれています。ProgramBench はこれらを意図的に排除することで、モデルが実装戦略をゼロから合成することを強いています。評価は実行ベースで行われ、held-outのテストケースに対する pass@k(k \in \{1, 5, 10\})を用います。

結果は、HumanEval におけるbenchmark性能と比較して急激な低下を示しています。強力なフロンティアモデルでさえ、複数関数からなるプログラムや非自明なアルゴリズムが必要とされる難しい ProgramBench のインスタンスでは、pass@1 が大幅に低下します。このbenchmarkが明らかにした特定の失敗モードとして、モデルが局所的には妥当だが大局的には一貫性を欠くプログラムを頻繁に生成するという現象が挙げられます——各サブルーチンは正しいにもかかわらず、全体として正しく組み合わさらないのです。

また、chain-of-thought prompting はスコアをわずかに向上させるものの一様ではなく、改善は中程度の難易度の問題に集中しているとも報告されています。難しい問題は依然としてほぼ未解決のままであり、現在のモデルが長期的なコード合成の計画立案部分に苦労していることが示唆されます。

限界として、実行ベースのpass/fail評価では部分的な正しさを区別できないこと、テストスイート自体にカバレッジの漏れが存在する可能性があること、そしてbenchmarkが競技プログラミング的な問題に偏っており、産業界のソフトウェアタスクを代表しない可能性があることが挙げられます。このbenchmarkが明らかにしたギャップは実在しますが、実用的なコーディング支援への一般化については慎重を要します。

Source: https://arxiv.org/abs/2605.03546

DeepSeek 4 Flash: Metal向けローカル推論エンジン

AntirezによるAntares ds4は、Apple Silicon向けにMetal GPU Compute APIを使用してゼロから実装されたC言語の推論エンジンであり、DeepSeekの量子化モデルに特化して設計されています。このプロジェクトはllama.cppとMLXへの依存を避け、DeepSeekのmixture-of-expertsルーティング、multi-head latent attention(MLA)、およびgrouped-query attentionを含む完全なforward passを、Metal shaderを用いたC言語で直接実装しています。

技術的に注目すべき点はMLAの実装です。DeepSeek V2/V3/R1は低ランクKV圧縮を採用しており、キャッシュ前にキーと値を潜在次元 d_c \ll d_{kv} へ射影し、attention時にわずかなup-projectionを行うコストで、KV cacheのメモリを約 10\times 削減します。カスタムkernelでこれを正確に実装するには、吸収された射影行列の丁寧な処理が必要です。DeepSeekの推論ドキュメントでは、RoPE位置エンコーディングが低ランク構造と非自明な形で相互作用するため、圧縮前にキーをRoPEコンポーネントと非RoPEコンポーネントに分割する必要があることが指摘されています。

MoEルーティングについては、DeepSeekが採用するshared-expertアーキテクチャ(一部のexpertが常時アクティブで、残りはトークンごとに選択される)によるtop-k expert選択を実装しています。ルーターlogitに対するsoftmaxおよび選択されたexpert出力全体にわたるsparse accumulationには、MetalのSIMD-group演算が使用されています。

量子化サポートはQ4およびQ8フォーマットを対象としており、行列乗算kernelにMetal側のdequantizationが融合されているため、dequantの独立したパスが不要です。その結果、数千行という最小限かつ監査しやすいコードベースが実現し、M系列チップ上で中規模のDeepSeek variantに対して競争力のあるトークンスループットを達成しています。

既知の制限事項として、バッチサイズ1を超えるbatchingへの非対応、speculative decodingの未実装、およびMetalにpersistent thread groupsがないためKV cache管理がCUDA相当より非効率である点が挙げられます。それでも、DeepSeekのアーキテクチャをkerrelレベルで理解するためのリファレンス実装として有用です。

Source: https://github.com/antirez/ds4

注目の新規リポジトリ

Tencent-Hunyuan/HY-World-2.0

HY-World 2.0は、3つの連携タスク——画像・動画からの3Dシーン再構築、新規3D環境の生成合成、シーンダイナミクスの順方向シミュレーション——を対象としたマルチモーダルworld modelです。このアーキテクチャは、video diffusion backboneと明示的な3D表現層を組み合わせており、各フレームを独立して処理するのではなく、生成されたフレーム全体にわたってジオメトリの一貫性を維持できます。再構築パイプラインはシーンのジオメトリと外観を同時に推定し、無条件生成や初期状態・行動シーケンスを条件とした conditional rollout の両方をサポートする潜在空間へと入力されます。シミュレーションコンポーネントは、本モデルを embodied agent 向けの環境モデルとして位置付けており、フォトリアリスティックかつジオメトリ的に整合したrolloutによってsim-to-realギャップを低減します。マルチモーダルな条件付けは、テキスト・画像・depth priorをカバーしています。リリースにはモデルの重み、推論コード、および評価スクリプトが含まれています。HY-World 1.xなどの前世代モデルとの技術的な差別化点は、時間的コヒーレンスの向上と、個別の専用ヘッドではなく1つのモデル内で3つのタスクすべてを統一的に扱う点にあります。未解決の課題としては、無制限のシーン範囲へのスケーラビリティや、遮蔽下における動的オブジェクトのインタラクションの再現精度が挙げられます。

Source: https://github.com/Tencent-Hunyuan/HY-World-2.0

facebookresearch/neuroai

NeuroAIは、視覚・聴覚・体性感覚モダリティにわたるシステム神経科学と深層学習研究を橋渡しすることを目的として、FAIRが開発したPythonライブラリです。中核となる抽象化は、標準化されたベンチマークパイプラインです。すなわち、事前学習済みニューラルネットワークモデルを読み込み、指定したレイヤーで中間表現を抽出し、神経集団の記録データに対して線形読み出し(linear readout)を fitting し、説明分散(explained variance)やノイズ補正済み相関といった標準的な神経科学メトリクスを用いて予測精度を評価します。NeuralBench、Brain-Score、およびFAIR独自の記録データセットを統一されたAPIでラップしており、クロスモダリティ比較を困難にしていたボイラープレートコードを削減しています。本ライブラリは、回帰を必要とせずにモデルの活性化と神経データの間の幾何学的比較を行うために、RSA(representational similarity analysis)とCKA(centered kernel alignment)をサポートしています。PyTorchのモデルzooとの統合により、torchvisionやHuggingFaceのあらゆるモデルを最小限のアダプタコードで神経ベンチマークに対して評価することが可能です。実用的な観点からは、タスク精度だけでなく神経予測性を標的としたアーキテクチャのアブレーション実験を迅速に繰り返すことができ、深層ネットワークのどの帰納バイアスが生物学的計算に対応するかを理解するうえで有益です。

Source: https://github.com/facebookresearch/neuroai

kyegomez/OpenMythos

OpenMythosは、Anthropicのモデルであるモデルの仮説的な内部アーキテクチャを再構築しようとする投機的なリバースエンジニアリングの試みです。公開されている研究論文、ブログ記事、技術レポートのみを基にしており、独自のコードや重みは一切含まれていません。このリポジトリは、Constitutional AI reward modeling、多段階のcritique-revisionループ、Claudeの報告されているコンテキスト長と挙動特性と整合する推定 attention パターンなど、アーキテクチャ上の仮説を実行可能なPyTorch実装へと落とし込んでいます。その価値は主に教育的な観点にあります。すなわち、文献上で曖昧な部分について具体的なアーキテクチャ上の選択を迫ることで、暗黙的な仮定を明示的かつ検証可能な形にしてくれます。各モジュールには、設計上の選択を動機づけた特定の論文への引用が注釈として付されています。高いスター数は、プロダクション用途としての有用性ではなく、フロンティアモデル内部の解釈可能な再構築に対するコミュニティの関心を反映しています。重要な注意点として、実際のモデルのアーキテクチャは非公開であるため、ここでのすべての構造的決定は根拠のある推測であり、事実として扱うべきではありません。本プロジェクトは、Constitutional AIおよびRLHF関連の文献を読む際の補助資料として最も有用であり、理論を探求するための実行可能なスケルトンを提供してくれます。

Source: https://github.com/kyegomez/OpenMythos

walkinglabs/hands-on-modern-rl

hands-on-modern-rl は、古典的な表形式強化学習およびDeep RLの基礎から、現代的なLLMアライメント手法やエージェント的システムへと段階的に進むオープンカリキュラムです。序盤のモジュールでは、policy gradientの導出、Q-learningのバリアント、actor-criticアーキテクチャを、自己完結したJupyter notebookとともに扱っています。カリキュラムはその後、proximal policy optimization(PPO)と、それをRLHFパイプラインに適用する内容へと移行し、InstructGPTスタイルの学習で用いられるセットアップを反映した実装が提供されています。Reinforcement Learning from Verifiable Rewards(RLVR)に関する専用セクションでは、グランドトゥルースシグナルが利用可能な場合(例:数学の検証、コード実行)のreward modelingを扱い、学習された選好モデルとの対比が行われています。エージェント的なトラックでは、ツール使用環境、部分観測下での多段階推論、そして長いアクション系列にわたって報酬がスパースな場合に生じる特有のcredit assignmentの課題を取り上げています。コードはPython、PyTorch、および軽量なgym互換環境を対象とした再現可能なスタックを前提としており、重厚なインフラへの依存を避けています。このリソースが埋めるギャップは、古典的なRLの数学的基礎と、現在LLMのpost-trainingを支配している特定のアルゴリズムのバリアントを結びつける単一のリソースが存在しないという点であり、RLのバックグラウンドからLLMアライメント分野に参入する研究者、あるいはその逆の立場の研究者にとって有用な内容となっています。