デイリーAIダイジェスト — 2026-05-08

arXiv ハイライト

UniPool: Mixture-of-Experts のためのグローバル共有 Expert Pool

問題設定

標準的な MoE transformer は expert の容量を深さに紐付けています。L 層それぞれが E 個の expert からなるプライベートなバンクを保有するため、各層が独立した専門化を実際に必要とするかどうかに関わらず、expert パラメータの総数は L \cdot E に比例してスケールします。先行研究では、訓練済み MoE において層内の大規模な冗長性が示されています。具体的には、同一層の expert が主要な部分空間を共有しており、Qwen や DeepSeek の MoE ではペアのコサイン類似度が 0.9 を超えること、Mixtral 8x7B において約半数の expert を枝刈りしてもコストはわずか約 8% の相対的品質低下に留まること、また最も類似した同一層の expert へトークンを再ルーティングすることで最大 2 倍のデコード高速化を維持しながら精度が保たれることが報告されています。これらはいずれも事後圧縮の結果ですが、UniPool はこの冗長性が構造的なものであり、訓練時に除去されるべきと主張しています。

本論文はルーティングプローブによってこの診断をより精密化しています。深い半分の層の学習済み top-k ルーターを一様ランダムな割り当てに置き換えると、5 つのベンチマーク平均でダウンストリームの精度がわずか 1.0 点(Qwen3-30B-A3B)、1.2 点(DeepSeek-V2-Lite)、1.6 点(Qwen1.5-MoE)しか低下しません。深い層の expert が真に異なる専門化を持つならば、ランダム化の影響はもっと大きいはずです。この解釈として、層ごとの所有権が各ブロックに対して薄い層単位の gradient 信号から独立して類似した変換を再発見させることを強いており、冗長な深層 expert を生み出しているとされています。

手法

UniPool は層ごとの所有権制約を取り除きます。層 l における通常の MoE FFN は

\text{FFN}_l(x) = \sum_{i \in \text{Top-}k(r_l(x))} g_{l,i}(x)\, e_{l,i}(x),

と表され、ここで \{e_{l,i}\} は層プライベートです。UniPool は L 個すべてのバンクを一つのグローバル pool \mathcal{E}=\{e_1,\dots,e_M\} に置き換えます:

\text{FFN}_l(x) = \sum_{i \in \text{Top-}k(r_l(x))} g_{l,i}(x)\, e_i(x).

残差ストリームの分布が深さによって異なるため、ルーター r_l は層ごとに保持されますが、expert パラメータは層をまたいで共有されます。pool のサイズ M は、アクティブな FFN 計算を dense 相当に保ちながら、通常の MoE の expert パラメータ予算に合わせて設定されます。

共有を安定させるために 2 つの訓練メカニズムが導入されています:

Pool レベルの補助的バランシング。 標準的な負荷分散 loss は層ごとに計算されますが、共有下ではこれは粒度として誤りです。ある expert の利用率は全層にわたる合計となるからです。UniPool は pool 全体にわたって利用率を集約し、そのレベルでバランシングを行います。アブレーション(表 5)はこれが重要であることを示しており、層ごとの aux loss を用いた shared pool では loss 1.9480(通常の MoE の 1.9317 より悪化)となるのに対し、pool レベルの aux loss を用いた shared pool では 1.9180 となります。

NormRouter。 softmax-with-large-G を置き換えるスケール安定なルーティング演算子であり、shared pool へのスパースかつノルム制御されたゲーティングを提供します。NormRouter 単体では通常の MoE に対してほぼ中立(1.9375 対 1.9317)ですが、pool レベルの共有と組み合わせることで UniPool の最終結果 1.9029 が得られます。

著者らは中間的な「共有スコープ」G についてもスイープしており、G{=}L は通常の MoE(12 の分離バンク、182M の深さ)に戻り、G{=}1 が完全共有となります。loss は共有の強度に対して単調であり、G{=}6 で 1.9121、G{=}4 で 1.9099、G{=}2 で 1.9213、G{=}1 で 1.9029 となります。

結果

Pile の 30B トークンで訓練された LLaMA スタイルの 5 つのスケール(182M、469M、650M、830M、978M のアクティブパラメータ)、8 expert/top-1 設定において、UniPool はすべてのスケールで通常の MoE を上回ります:

| スケール | 通常の MoE loss / PPL | UniPool loss / PPL |

|---|---|---|

| 182M | 1.9317 / 6.9012 | 1.9029 / 6.7058 |

| 469M | 1.7982 / 6.0388 | 1.7636 / 5.8334 |

| 650M | 1.7568 / 5.7940 | 1.7260 / 5.6186 |

| 830M | 1.7309 / 5.6458 | 1.6923 / 5.4320 |

| 978M | 1.7171 / 5.5683 | 1.6999 / 5.4736 |

0.017〜0.039 nat の loss 削減は一貫しており、830M において最大となっています。

最も情報量の多い分析はルーティング感度比較(Section 6.1)です。自身の訓練済みモデルにおいて、深い半分の層のルーターをランダム化すると、通常の MoE の精度は 1.3 点(469M)および 1.5 点(978M)低下し、プロダクションモデルのパターンが再現されます。UniPool におけるカーディナリティが一致した top-8 ランダムプロトコルでは、両スケールで 4.1 点に上昇します。shared pool は深さに起因する冗長性をその層ごとの専門化へと変換しており、ルーターが呼び出す再利用可能な計算は実質的により多くの情報を担うようになっています。

制限と未解決の問題

評価された最大のモデルは 1B アクティブパラメータ未満であり、すべて 30B トークンで訓練されており、フロンティアスケールや Chinchilla 最適なトークン予算において loss のギャップが持続するか縮小するかは検証されていません。設定は 8 expert top-1 に限定されており、細粒度 MoE(多数の小さな expert、大きな top-k)や shared-expert ハイブリッドでの挙動はここでは報告されていません。pool サイズ M は通常のパラメータ予算に合わせて固定されているため、深さに対して expert 数を削減できるという分離の主張は言明されているものの、見出しの表では計算コスト削減として活用されていません。ルーティングのダイナミクス(例えば、深い層と浅い層が pool の互いに素な領域か重複する領域に収束するか)はランダム化プローブを通じてのみ間接的に扱われています。

なぜ重要か

UniPool は深い MoE の冗長性を、事後的に枝刈りされるべきアーティファクトとしてではなく、アーキテクチャ上の選択——層ごとの expert 所有権——の結果として捉え直し、適切なバランシングを伴って pool を共有するだけで一貫した loss の改善が得られ、かつルーターの決定がランダム化下で 3〜4 倍より大きな負荷を担うようになることを示しています。これがスケールするならば、MoE のパラメータ予算は深さに対して線形にスケールしなくなり、メモリとサービングコストに直接的な影響をもたらします。

Source: https://arxiv.org/abs/2605.06665

RLはLLMに長期推論を教えられるか?表現力が鍵

問題設定

RLによるpost-trainingがLLMの推論ホライズンを拡張できるか、またそのコストはどの程度かという問いは、自然なベンチマークがホライズン長と語彙・世界知識・表層形式を混同してしまうため、研究が困難でした。本論文は、(i)証明の深さ D と(ii)基礎論理の表現力を独立に変化させる合成環境によってこの問いを切り分け、目標精度に到達するためのRLの計算量 T が各軸に沿ってどのようにスケールするかを調べます。

ScaleLogicの構成

各インスタンスは B 個の候補結論を持つ多肢選択問題であり、そのうちちょうど一つが公理集合から導出可能です。インスタンスは後ろ向きに構築されます。B 個の根リテラルから始めて、生成器は目標深さ D まで証明木を再帰的に展開し、各親ノードはその子ノードとともに一つの証明ステップを形成します。各展開で新しい述語を使用することにより、各ノードが公理から一意に導出されることが保証されます(これはショートカット証明を排除し、Opedal et al., 2025 の精神に近いアプローチです)。

B 本の木のうち B-1 本については、一つの公理が破損されます。破損は削除によるか、論理がそれをサポートする場合にはリテラルの極性を反転させることで行われます(例:\text{cat}(\text{Alice}) \to \neg\,\text{cat}(\text{Alice}))。一意導出可能性により、一つの公理を切断すると対応する根が導出不可能になることが保証されます。代替証明を有効にすることなく局所的な曖昧さを注入するために、少数の撹乱ルールが追加されます。

表現力の軸は厳密な階段構造をなしています。含意のみ(\to)から始まり、+\text{Conjunction}、+\text{Disjunction}、+\text{Negation}、+\text{Quantification}(全称、一階)と続きます。上位の段では、より豊かな証明ステップ(例:選言に関する場合分け、全称例化)が許容されるため、より表現力の高い論理における深さ D の証明は、単に長いだけでなく、1ステップあたりの難易度が真に高くなります。

RLの設定

Post-trainingはQwen3-4Bの非thinkingバリアント(Qwen3-8Bで再現実験)に適用され、verlで実装されています。モデルは問題を受け取り、正しい候補を出力しなければなりません。報酬は一意の正解から検証可能です。主要な実験では、各論理ごとに各深さ D において固定した精度閾値に到達するために必要な計算量 T を測定します。計算量の代理指標としては、生成トークン数 T_{\text{gen-tok}}、保持バッチトークン数 T_{\text{upd-tok}}、およびFLOPs T_{\text{FLOPs}} = 2N\,T_{\text{gen-tok}} + 6N\,T_{\text{upd-tok}} を含む複数の指標を用います。

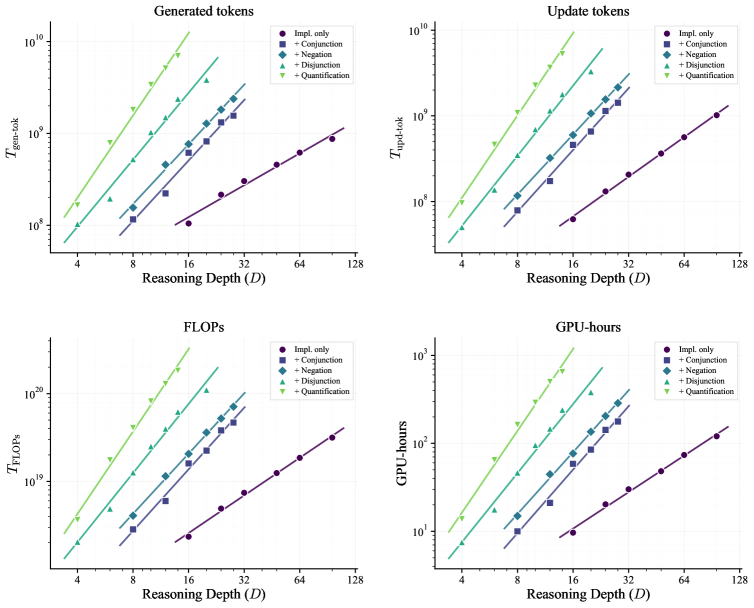

深さにおけるべき乗則スケーリング

すべての表現力設定において、目標到達に要する計算量は

T(D) = a \cdot D^{\gamma}, \qquad R^2 > 0.99

としてスケールします。べき乗則は指数関数的フィットを厳密に上回り、\Delta\text{AIC} は一貫して D^\gamma を支持し、「各ステップの追加がコストを定数倍する」という素朴な仮説を否定します。

指数 \gamma は論理の表現力とともに単調に増加し、含意のみの場合の \gamma \approx 1.04 から、量化を含む完全な一階設定の \gamma \approx 2.60 まで上昇します。言い換えれば、深さの単位増加に対するRLの限界コストは、最も単純な論理では概ね線形ですが、連言・選言・否定・\forall のすべてが加わると二乗を超えます。同じ指数は代替計算量指標(生成トークン数、保持バッチトークン数、FLOPs)においても成立しており、このスケーリングがトークン計算の問題ではなく学習問題の性質であることを示しています。

下流タスクへの転移

合成論理のみで学習しているにもかかわらず、より表現力の高い学習分布は数学および一般推論ベンチマークへの転移が優れています。最も表現力の高い設定ではベースモデルに対して最大 +10.66 ポイントの改善が得られ、より少ないRLの計算量で所定の下流精度に到達します。これは実用上重要な知見です。難しい論理カリキュラムにRLの計算量を投じることは、浅いが大量のchain形式のデータに投じるよりも、下流推論においてサンプル効率が高いことを意味します。

著者らはさらに、このスケーリングパターンがアルゴリズム固有のものでないこと(RQ4)、および深さ D で学習したモデルが未見のより大きな深さに対しても非自明な精度を保持すること(RQ5)を確認しており、この効果が深さ D のテンプレートの暗記ではなく、獲得された手続き的能力を反映していると論じています。

限界

この環境は新しい述語と一意証明を用いた合成環境であり、実際の推論に含まれる曖昧な導出・補題の再利用・自然言語の言い換えはScaleLogicによって意図的に除外されています。「閾値到達に要する計算量」という指標は任意の精度目標に依存しており、異なる閾値やモデルスケール(4Bと8Bのみテスト)では指数が変化する可能性があります。また、表現力の階段は複数の異なる論理演算子を一まとめにしており、\gamma の急激な増加に個別に責任を持つ演算子(否定か?量化か?)はまだ明らかになっていません。

重要性

これは、長期推論に対するRLの学習コストが深さに関してべき乗則に従い、その指数が推論の種類に依存することを(長さだけでなく)初めて明確に示したものです。この結果は「推論のためのRLのスケーリング」をカリキュラム設計の問題として再定式化します。適切な表現力を選択することで \gamma を ~1 から ~2.6 へと変化させることができ、これは扱いやすいホライズンと扱いにくいホライズンの差に相当します。

Source: https://arxiv.org/abs/2605.06638

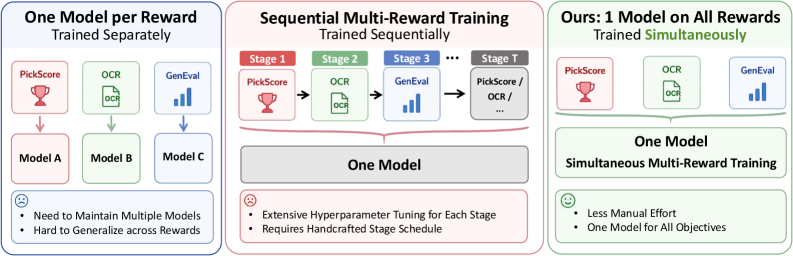

MARBLE: Multi-Aspect Reward Balance for Diffusion RL

問題設定

テキストから画像を生成するdiffusionモデルのRL fine-tuningでは、プロンプト整合性・人間の嗜好・OCR忠実度・構成的正確さ・美的品質など、複数の異種基準を同時に満たす必要があります。現状では以下の3つの不満足な選択肢のいずれかを取ることになります:(i) 報酬ごとに専用のスペシャリストモデルを個別に訓練する、(ii) R(x)=\sum_k w_k R_k(x) によるスカラー化を行い単一のRLループを回す、(iii) 報酬のサブセットを各段階のターゲットとする逐次的なステージを手動でスケジューリングする。

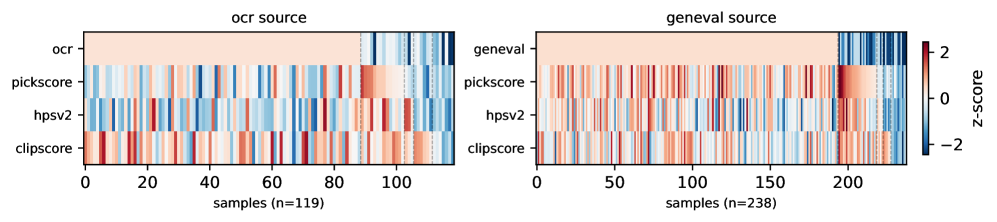

著者らは、単なる重みチューニングの悩み以上の、スカラー化の具体的な失敗モードを特定しています。典型的なロールアウトバッチでは、ほとんどのサンプルがスペシャリストサンプルです:判読可能なテキストをたまたま生成したサンプルはOCR報酬に対して高い情報量を持つ一方、HPSv2やCLIPに対してはほぼゼロのシグナルしか持ちません。構成的に正しいシーンはGenEvalに対して情報量を持ちますが、OCRに対しては持ちません。経験的には、報酬ごとのzスコア化されたadvantage A_k(x) はスパースであり、異なるサンプルに対して異なる行に集中しています。

重み付き和がこれらを単一のスカラーadvantage A(x)=\sum_k w_k A_k(x) に崩してしまうと、次元 k における強いスペシャリストシグナルが残り K-1 次元のノイズで平均化され、その報酬の学習を推進すべきサンプルにおいてまさに監督信号が希釈されてしまいます。

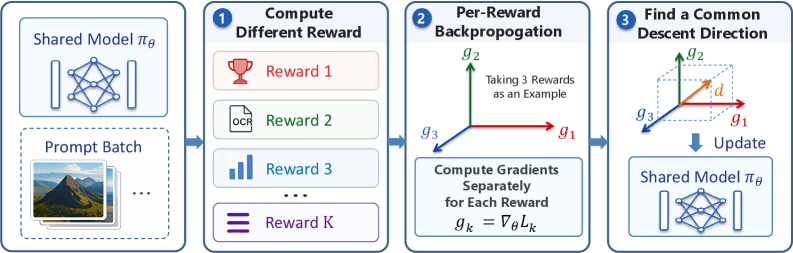

手法

MARBLEは報酬ごとのadvantage構造をそのまま保持し、報酬空間ではなく勾配空間でコンフリクトを解決します。単一報酬に対するDiffusionNFTのノイズフリー訓練lossを基盤とし、それは以下のように定義されます:

\ell(\theta;x,t)=r\cdot\mathcal{L}^{+}(\theta)+(1-r)\cdot\mathcal{L}^{-}(\theta),\qquad r=\mathrm{clamp}\!\left(\tfrac{1}{2}+\tfrac{A(x)}{2A_{\max}},0,1\right),

速度予測ターゲットは

\mathcal{L}^{+}=\|v_\theta^{+}-v\|^2,\quad \mathcal{L}^{-}=\|v_\theta^{-}-v\|^2,

ここで v_\theta^{\pm}=(1\mp\beta)v^{\mathrm{old}}\pm\beta v_\theta は現在のポリシーと参照ポリシーの間を補間します。重要なのは、\mathcal{L}^{\pm} が \theta とサンプルのみの関数であり、advantageはスカラー r\in[0,1] を通じてのみ入力されるという点です。これにより、報酬ごとのlossを安価にインスタンス化できます:K 個の報酬が与えられた場合、K 個の補間係数 r_k(x)=\mathrm{clamp}(\tfrac12+\tfrac{A_k(x)}{2A_{\max}},0,1) と K 個のlossを計算します:

\mathcal{L}_k(\theta)=\mathbb{E}_{x,t}\!\left[r_k(x)\mathcal{L}^{+}(\theta;x,t)+(1-r_k(x))\mathcal{L}^{-}(\theta;x,t)\right].

各報酬は独立した逆伝播によって独立した勾配 g_k=\nabla_\theta \mathcal{L}_k を生成します。次に勾配ハーモナイゼーションステップが \{g_k\} を、すべての \mathcal{L}_k を減少させる、すなわちすべての k に対して \langle d,g_k\rangle\ge 0 を満たす単一の降下方向 d に結合します。これは報酬空間のスカラー化を、多目的勾配集約(MGDA/PCGradスタイルの解を含むファミリー)に置き換えるものです。共有のLoRAアダプト済みモデルは d によって更新されます。

構造的な利点:単一の k に対して A_k\gg 0 を持つサンプルは r_k\!\to\!1 を通じて強い \mathcal{L}^+ 方向の引力を生み出す一方、r_{j\ne k} は平均化によって洗い流されるのではなく 0.5 付近(シグナルなし)に留まります。

実験

バックボーンはLoRA rank 32、alpha 64、AdamW 3\times 10^{-4} のStable Diffusion 3.5 Mediumであり、16台のH200上で訓練されます。5つの訓練報酬:PickScore、HPSv2、CLIPScore(汎用)、加えてOCR精度とGenEval(スペシャリスト)。ホールドアウト評価器として、Aesthetic Score、ImageReward、UniRewardが転移性能の検証に使用されます。

ベースライン: - FlowGRPO 単一報酬スペシャリスト(報酬ごとに1モデル)。 - DiffusionNFT sequential†:手動スケジューリングによるマルチステージ訓練。 - DiffusionNFT simultaneous‡:重み付き和によるスカラー化。

選択されたセクションはセットアップを説明していますが、結果の完全なテーブルは列挙されていません。論文の主張は、MARBLEが各報酬において単一報酬スペシャリストに匹敵または凌駕しながら単一の統合ポリシーを生成し、希釈病理に悩まされるスカラー化された同時ベースラインを上回り、逐次変種が必要とする手動のステージスケジューリングを回避するというものです。ホールドアウト報酬(Aesthetic、ImageReward、UniReward)は転移の確認として報告されており、いずれも訓練には使用されていません。

限界と未解決の問題

- 提供されたセクションでは、どの勾配ハーモナイゼーションルール(MGDA、PCGrad、CAGradなど)が使用されているかが明記されていません。コストと挙動はこの選択に強く依存します。K=5 でLoRAのみのパラメータであれば K 回の追加逆伝播は扱いやすいですが、K をスケールアップしたりベースモデルをアンフリーズしたりすると、メモリ・計算量の懸念が生じます。

- clamp内の A_{\max} は報酬ごとのハイパーパラメータであり、その較正は各報酬が r_k にどれほど積極的に寄与するかに影響します。

- このフレームワークはDiffusionNFTの凍結参照 v^{\mathrm{old}} とKLスタイルの正則化 \beta_{\mathrm{KL}} への依存を引き継いでいます。長期訓練におけるドリフト挙動は抜粋では報告されていません。

- 個々の R_k に対するreward hackingは排除されていません。勾配ハーモナイゼーションは報酬間の希釈を防ぐだけであり、報酬内の悪用は防ぎません。ホールドアウト評価器がこれに対する唯一のチェックです。

- 報酬が真に競合している場合(例:美的嗜好と厳密なOCR)に共通の降下方向が存在しないとき、MARBLEがどのように振る舞うかは不明です。その場合、ハーモナイゼーションステップはほぼゼロの d を返すことになります。

この研究の意義

多目的RL fine-tuningはプロダクション向けdiffusionモデルの実運用上の状況であり、支配的な手法である重み付き和報酬は、ロールアウトが報酬スパースな場合(ほぼ常にそうである)に証明可能な意味で損失が大きいことが示されます。MARBLEは問題を「重みを選ぶ」から「共通の降下方向を見つける」へと再定式化し、手動チューニングされたカリキュラムに対する原理的な単一モデルの代替手段を提供します。

Source: https://arxiv.org/abs/2605.06507

Continuous Latent Diffusion Language Model

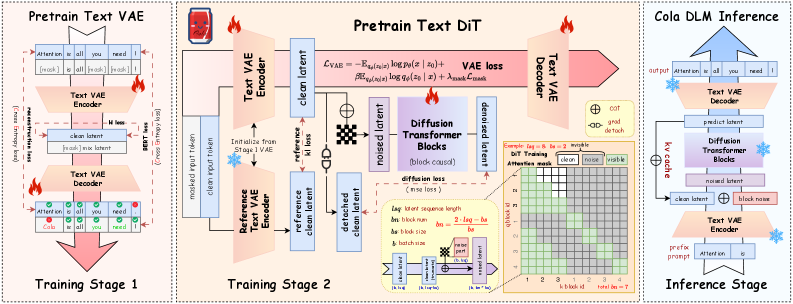

Cola DLMは、連続潜在事前分布をflow-matching DiTが学習し、表面トークンを条件付きdecoderが生成するという、テキスト生成のための階層的潜在変数定式化を提案しています。その動機は、大域的な意味的構造と局所的なトークン実現を切り離すことにあります。トークン空間におけるdiffusion(LLaDA、Plaid)は破壊パスのdenoisingと観測の復元を混同しており、一方でARはモデルの状態を表面プレフィックスに結びつけているという前提に基づいています。

モデルと学習

生成モデルは以下のように分解されます:

p(x) = \int p_\theta(x \mid z_0)\, p_\psi(z_0)\, dz_0,

三つの構成要素を持ちます:学習時のみ変分推論に用いられるencoder q_\phi(z_0\mid x)、decoder p_\theta(x\mid z_0)、そして基底分布 p_1(z_1)=\mathcal{N}(0,I) とODE dz_t/dt = v_\psi(z_t,t) によって定義される連続フロー事前分布 p_\psi(z_0) であり、p_\psi = (\Phi^\psi_{0\leftarrow 1})_\sharp p_1(式9.8)となります。潜在変数は B 個のブロックに分割され、ブロック因果分解

p_\psi(z_0) = p_\psi(z_0^{(1)}) \prod_{b=2}^{B} p_\psi(z_0^{(b)} \mid z_0^{(<b)})

が採用されており、これはDiTがブロック因果attention maskによって実施するものです。学習は二段階で進められます(図1参照):Stage 1ではテキストVAEを再構成、補助BERT目的関数、KLペナルティによって事前学習し、Stage 2ではVAEとDiTを事後崩壊防止のための勾配制御とともに共同学習し、以下のELBOを最適化します:

\mathbb{E}_{p_\text{data}}[-\mathcal{L}_\text{ELBO}] = H(p_\text{data}) + \mathrm{KL}(p_\text{data}\Vert p_{\theta,\psi}) + \mathcal{G}^\text{infer}_\text{Cola DLM}(\phi,\theta,\psi),

ここで推論ギャップ \mathcal{G}^\text{infer}\geq 0(式12.5–12.6)です。

flow-matching lossは標準的な速度回帰 \mathcal{L}_\text{FM}(\psi) = \mathbb{E}\,\|v_\psi(Z_t,t,c) - U^\star\|^2 であり、その点ごとの最適解は条件付き平均速度 f^\star(z,t,c) = \mathbb{E}[U^\star\mid Z_t=z,t,c](命題14.1)です。論文では、これが動的システムの回帰であり、ゴールド潜在変数における局所的な対数密度の最大化ではないことを明示しています。これが後述するPPL/品質の不整合の原因です。

推論

サンプリングは二段階です:z_1\sim\mathcal{N}(0,I) を引いてODEを逆方向に z_0 まで積分し、次に x\sim p_\theta(x\mid z_0) をデコードします。プレフィックス条件付きタスクでは、プレフィックスを z^\text{pre}\sim q_\phi(\cdot\mid x^\text{pre}) にエンコードし、応答ブロックを以下のように生成します:

\hat z_0^{(b)} = \Phi^\psi_{0\leftarrow 1}(\epsilon^{(b)}; z^\text{pre}, \hat z_0^{(<b)}),\quad \epsilon^{(b)}\sim\mathcal{N}(0,I),

そして全テキストを (x^\text{pre}, z^\text{pre}, \hat z_0^{(1:B)}) からデコードします。ここでのパスは観測から独立しており、潜在事前分布のトランスポートです。これが、セクション11の統一マルコフパスの観点から見た、LLaDAのマスク破壊パスおよびPlaidのトークン空間diffusionとの構造的な違いです。

実験設定と知見

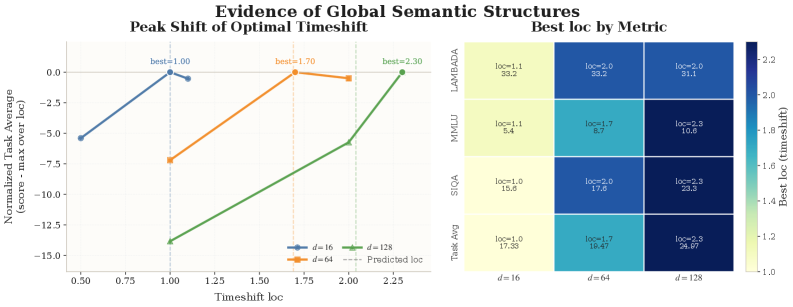

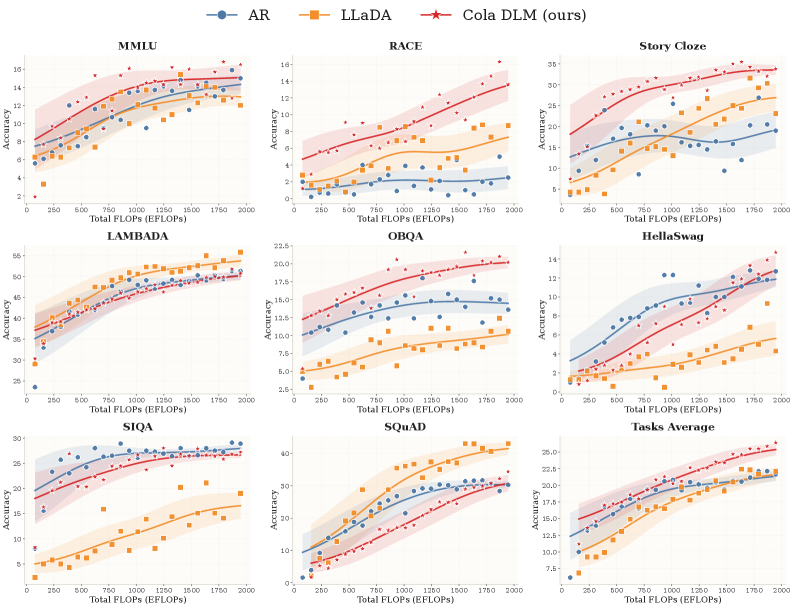

VAEは5億パラメータ、DiTは18億パラメータで合計約20億です。ARおよびLLaDAのベースライン(LLaMAとLLaDAの実装)は約4億のembedding + 18億のバックボーンで揃えられており、同一のOLMo 2トークナイザー、同一データ、同一シード、シーケンス長512、コサイン減衰(1.5\times 10^{-4} から 1\times 10^{-5})による100万ステップで学習されています。評価はLAMBADA、MMLU、SIQA、SQuAD、Story Cloze、OBQA、RACE、HellaSwagにわたる統一few-shot精度(文字列マッチ)で行われます。セクション14で論じるように、学習目的関数が条件付き対数密度評価と整合しないため、著者は意図的にPPLを避けています。

潜在空間プローブ(RQ1)は最も理論的に鋭い結果です。潜在変数が分離可能で均質な局所次元の和であるという帰無仮説のもとでは、最適logSNRシフト \delta^\star_d は潜在次元 d によらず不変でなければなりません(命題13.2:\mathcal{J}_d(\delta) = a_d j(\delta) + b_d は共通のargmaxを示唆します)。実験的には最適シフトが d に対して単調にずれており、分離可能な帰無仮説を棄却し、大域的意味論を担うクロス次元の結合構造の存在を示しています。

これはノイズスケジュールと \lambda(t)=\log\text{SNR}(t) の統一的な扱いによっても裏付けられています:\alpha_t^2+\sigma_t^2=1、\alpha_t^2=\text{sigmoid}(\lambda(t)) のもとで、シフト \lambda_\delta(t)=\lambda(t)+\delta は各生のタイムステップを異なるlogSNRレジームに再マッピングするのであり、抽象的な時間ラベルを平行移動するわけではありません。したがって、次元依存の最適 \delta は実効的な意味情報レベルの真の再較正を反映しています。

RQ4では、統一プロトコルのもとでのスケーリング(図10)において、Cola DLMが揃えられた約20億FLOPs予算でのタスク平均において最良を達成し、ARおよびLLaDAベースラインよりも強いスケーリング勾配を示しています。論文では、絶対的な多肢選択精度が全モデルで厳格な生成ルーブリックにより低下していることから、クロスメソッドの比較こそが関連するシグナルであると述べています。

限界と未解決の問題

PPL/品質の不整合(セクション14)は構造的なものです:flow matchingはベクトル場を回帰するため、ELBOもプラグイン条件推定量も p(x^\text{res}\mid c) を緊密に追跡せず、これにより標準的な尤度ベースのモデル選択が制限され、ARとの公平な比較が複雑になります。比較すべき適切な対象は総統計的負担 \mathfrak{R} = \mathcal{E}(\mathcal{M}) + \inf \mathcal{G}^\text{infer} ですが、推論ギャップは直接測定できません。ブロックサイズ B、VAEのKL重み、U^\star のブリッジングパスの選択はいずれも、最適設定が導出ではなく実験的に報告されているパラメータです。論文では一致した品質での実時間またはサンプリングステップ効率を報告しておらず、約20億パラメータを超えるスケールでの検証もないため、良好なスケーリング勾配が持続するかどうかは未解決です。最後に、encoderは学習時にのみ必要ですが、推論時のプレフィックス条件付けは依然として q_\phi を経由するため、テスト時に事前分布との不整合が生じる可能性があります。

この研究の意義

Cola DLMは、潜在事前分布トランスポートとトークン出力の間に明確な確率論的分離を与え、ARやLLaDA、Plaidとどのように異なるかについて明示的な理論的説明(統一マルコフパスの枠組み、ELBO加推論ギャップ分解、大域的潜在構造に関する反証可能なテスト)を提供しています。次元依存のシフトドリフトは、テキスト上の連続潜在変数が非分離の大域的意味論を担うという具体的な証拠であり、統一的な連続モダリティ生成のための有用な基礎要素となります。

Source: https://arxiv.org/abs/2605.06548

少ステップ拡散蒸留のための連続時間分布マッチング

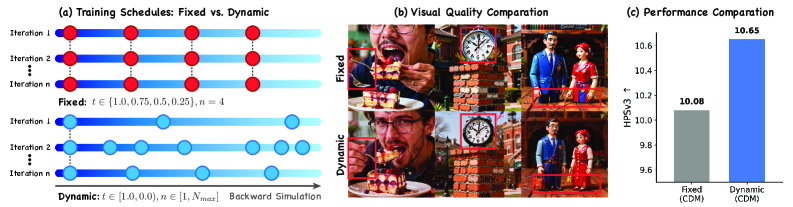

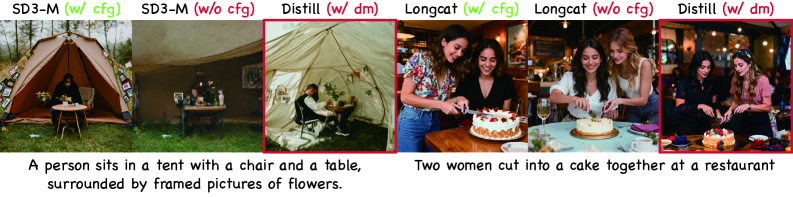

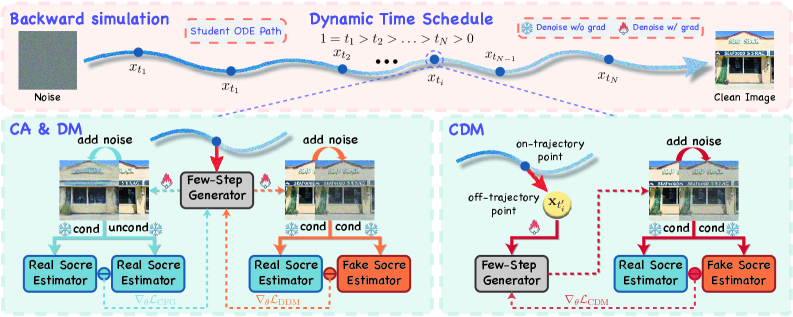

ステップ蒸留は2つのパラダイムに収束しています。一つは少数のアンカータイムステップにおいて学生分布と教師分布の間の逆KLを最小化するDistribution Matching Distillation(DMD)、もう一つはPF-ODE軌跡全体にわたって自己整合性を強制するConsistency Distillationです。DMDの離散的なアンカー設定はアンカー間の速度場を無制約のままにし、逆KLのmode-seeking性質は過度に平滑化された出力や視覚的アーティファクトを生じさせます。実際には、忠実度を回復するためにGANヘッドや報酬モデルの付加要素が必要とされてきました。本論文(CDM)は、補助的なlossを用いずにDMDを連続時間へと拡張します。具体的には、(i)推論スケジュールと軌跡長をイテレーションごとにランダム化し、(ii)マッチング目標を速度駆動の外挿によって到達する軌跡外潜在変数へと拡張します。

Decoupled DMDのベースライン

学生は速度場 v_\theta をパラメータ化しており、クリーンデータの予測は次式で表されます。

\mathcal{D}_\theta(\mathbf{x}_t,t,\mathbf{c}) = \mathbf{x}_t - t\,v_\theta(\mathbf{x}_t,t,\mathbf{c}).

学習には後退シミュレーションを用います。\mathbf{x}_{t_1}\sim\mathcal{N}(0,\mathbf{I}) から学生はPF-ODEを N ステップの推論スケジュール \{t_1,\dots,t_N\} に沿って積分し、インデックス i\sim\mathcal{U}\{1,\dots,N\} をサンプリングして、潜在変数 \mathbf{x}_{t_i} をアンカーとします。目標は \mathcal{L}_{\mathrm{DMD}} = \mathcal{L}_{\mathrm{CA}} + \mathcal{L}_{\mathrm{DM}} と分解されます。CAタームは新たにサンプリングされた \tau\in(0,1] においてCFGで増強された教師シグナルを注入します。

\mathcal{L}_{\mathrm{CA}} = \tfrac12\big\|\mathcal{D}_\theta - \mathrm{sg}[\mathcal{D}_\theta + w_\tau\alpha(\mathcal{D}_\phi(\mathbf{z}_\tau,\tau,\mathbf{c}) - \mathcal{D}_\phi(\mathbf{z}_\tau,\tau,\varnothing))]\big\|_2^2,

ここで w_\tau = \|\mathcal{D}_\phi(\mathbf{z}_\tau,\tau,\mathbf{c}) - \mathcal{D}_\theta\|_1^{-1} はgradient正規化のためのものです。DMタームは学生サンプルで学習された別途管理される「偽」教師に対する標準的な実/偽スコア減算を実行します。

動的連続スケジュール

最初の拡張は、学習中の固定推論グリッドを廃止することです。i\sim\mathcal{U}\{1,\dots,N\} をサンプリングして事前定義された \{t_1,\dots,t_N\} に沿って進む代わりに、CDMはイテレーションごとにアンカー時刻 t_i と軌跡長の両方を (0,1] から一様にサンプリングします。これにより学生は、N 個の事前決定されたアンカーではなく、任意の軌跡上の点で教師指導を受けることになります。

図2(b)の視覚的比較は、動的スケジュールを用いた学生がより鮮明なテクスチャを生成し、バニラDMDに特有の柔らかくぼやけた領域が少ないことを示しています。著者らは、これがより微妙な問題をも解決すると主張しています。\{t_1,\dots,t_N\} のみで学習する場合、学生の速度場はグリッド外では未定義であり、後退シミュレーションを通じて流れる逆KL gradientにバイアスが生じます。

DM lossは整合の主要ドライバーである

本論文における有用な診断ツールは図3です。DMタームのみ(CAなし)で学習した学生は教師のCFGフリーサンプルを忠実に再現する一方で、CAのみでは平均的な出力へと崩壊します。これにより、CAはテキスト条件付けの強化器として、DMは実際の分布アライナーとして位置づけることが正当化されます。これはLiu et al.(2025a)が提案したデカップリングですが、ここではSD3-MediumおよびLongcat-Imageにわたって視覚的に検証されています。

速度外挿による連続時間アライメント

第二の拡張はCDMの中核をなすlossです。シミュレートされた軌跡に沿ったアンカー設定のみでは、軌跡が一度も訪れない潜在変数上で学生の速度場が無制約のままになります。CDMは、軌跡上のアンカーから学生の予測速度に沿って新たな連続時刻へと外挿することで軌跡外プローブを構築し、その外挿点において分布マッチングを強制します。外挿には v_\theta 自体を用いるため、マッチングlossは (0,1] にわたって速度場にgradientを逆伝播させ、N 個の離散サイトではなく密に正則化します。動的後退シミュレーションが軌跡上および軌跡外の両方のマッチングを供給するパイプライン全体を図4にまとめています。

実験

実験はSD3-Mediumを 1024\times1024 で使用し、AES、PickScore、HPS v3、CLIP(ViT-H-14)を用いた2KのPickScoreテストプロンプト、および細粒度プロンプト遵守のための1KプロンプトによるDPG-Benchで評価しています。ベースラインにはHyper-SD、Flash、TDM、DMD2、D-DMDが含まれます。適用可能性はLongcat-Imageでもさらに示されています。選択されたセクションでは完全な定量的テーブルは列挙されていませんが、実験設計はCDMが対象とする失敗モードを直接テストしています。知覚的忠実度(DMDのmode-seekingアーティファクトが問題となる)のためにHPS v3とPickScore、プロンプト遵守(CAが主要な役割を担う)のためにDPGを使用しています。著者らは、CDMがHyper-SDおよびいくつかのDMD2バリアントとは対照的に、GANや報酬モデルの補助要素なしにこれらの結果を達成したと報告しています。

限界と未解決の問題

本論文は、提供されたセクションにおいて、図2の視覚的アブレーションを超えて、動的スケジュールと軌跡外外挿のそれぞれがどの程度の利得をもたらすかを定量化していません。軌跡外lossは外挿に学生自身の速度を使用しており、学習初期には循環的です。教師速度によるウォームアップが必要かどうか、および外挿ステップサイズ分布に対する結果の感度については不明です。逆KLのmode collapseは軽減されているものの除去はされていません。フレームワークは依然として逆KLサロゲートを使用しており、より密なサポート上で用いているにすぎません。最後に、デモンストレーションはflow-matching教師(SD3、Longcat-Image)で行われており、\epsilon-predictionのDDPMへの転用には式(1)の速度パラメータ化の再導出が必要になります。

なぜ重要か

CDMはDMDを離散アンカーから連続時間教師指導へと移行させた最初のクリーンな実装であり、アブレーションは従来のDMDバリアントにおけるGAN/報酬補助要素の繰り返しの必要性が、分布マッチングの根本的な限界ではなく疎な時間的教師指導の症状であったと主張しています。定量的結果が複数の教師にわたって確認されれば、少ステップ蒸留のレシピを大幅に簡略化することになります。

Source: https://arxiv.org/abs/2605.06376

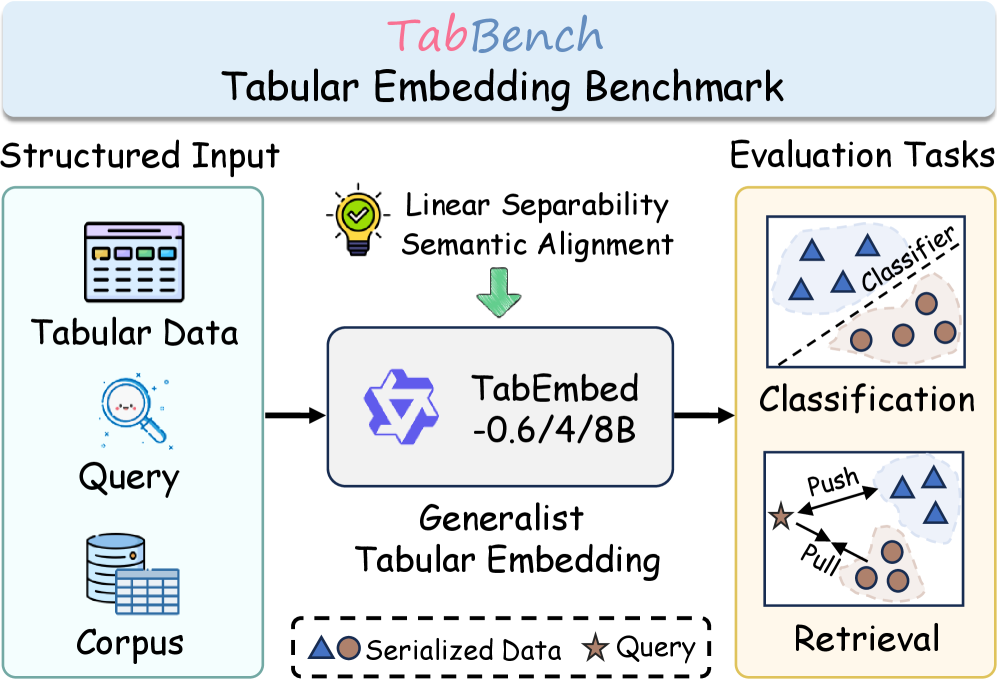

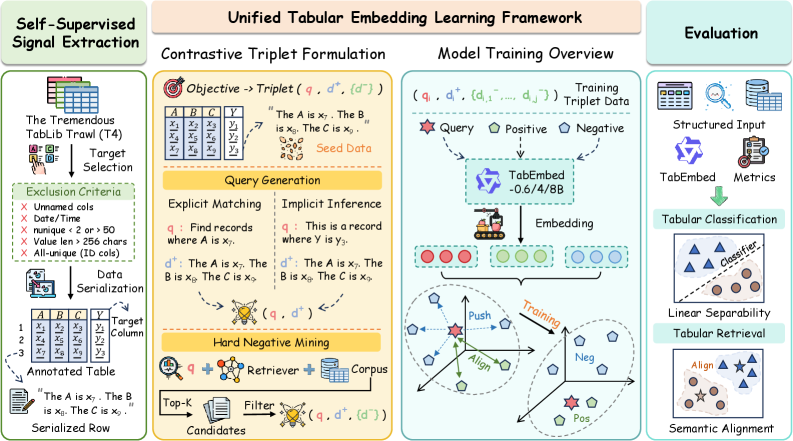

TabEmbed: 表形式理解のための汎用 embedding のベンチマークと学習

問題設定

Foundation model スタイルの統一表現はテキストに対しては成熟していますが、表形式データに対しては存在していません。現在の状況では2つの失敗パターンが支配的です:(i) LLM ベースの表形式予測器(例:TabLLM、TabuLa-8B)はテキストを生成するため、検索互換のベクトルを出力せず、最近傍探索・クラスタリング・テーブル上の RAG といった embedding スタイルのワークフローに利用できません;(ii) 汎用のテキスト embedder は、シリアライズされた行を入力として与えられた場合、数値の大小関係や構造的な手がかりに対して失敗します。これはそれらの事前学習目標が「年齢が67」と「年齢が76」の区別を必要としていなかったためです。本論文は評価上のギャップとモデル上のギャップの両方に取り組んでおり、シリアライズされた行に対する分類と検索を網羅するベンチマーク TabBench と、予測と検索を単一のベクトル空間に統合する対照学習済み embedding モデル TabEmbed を導入しています。

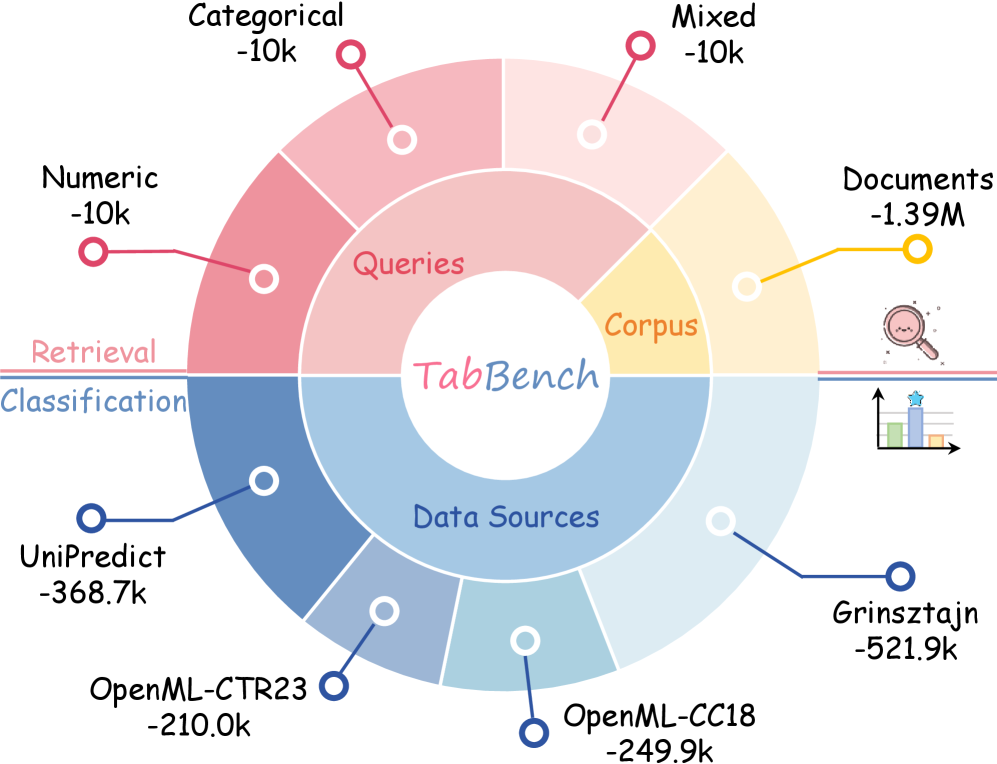

TabBench

TabBench は Grinsztajn、OpenML-CC18、OpenML-CTR23、UniPredict のデータセットを集約し、tabula-8b-eval-suite のキュレーションを基盤として構築されています。各行 \mathbf{x}=((h_1,v_1),\dots,(h_C,v_C)) は以下の式によってシリアライズされます:

\mathcal{S}(\mathbf{x})=\bigoplus_{j=1}^{C}\text{``The }h_j\text{ is }\tilde{v}_j\text{.''}

ここで \tilde{v}_j は数値・時間・バイナリフィールドに対する正規化された文字列です。embedder のコンテキスト予算を超える行はフィルタリングされます。評価軸は2つ使用されます:線形分離可能性(frozen embedding に対する分類精度/F1)と意味的整合性(列と値の制約を指定する自然言語クエリに対する MRR@10、nDCG@10)です。

TabEmbed の手法

TabEmbed は分類と検索の両方を言語対行の対照マッチングとして再定式化し、embedding が粗いクラスプロトタイプに崩壊してしまう行対行の alignment トラップを回避しています。

T4 コーパスからの自己教師あり triplet の構築は以下のように進みます。各テーブルに対して、自動化されたパイプラインが明確な意味的境界を持つターゲット列 y を選択し、識別子やタイムスタンプは除外されます。情報漏洩を防ぐため、行は y を除いた形でシリアライズされます:d=\mathcal{S}(\mathbf{x}_{-y})。自然言語クエリ q がアンカーとして合成され(分類のクラス条件または検索の複数制約フィルタのいずれかをエンコード)、d が正例として機能します。ハード負例は、同じターゲット値や制約条件を満たすものによる偽陰性を防ぐ positive-aware フィルタリングを用いてマイニングされます。

学習は Sentence-Transformers における標準的な InfoNCE 目標関数を使用します:

\mathcal{L}=-\log\frac{\exp(\langle f(q),f(d^+)\rangle/\tau)}{\sum_{d\in\{d^+\}\cup\mathcal{N}}\exp(\langle f(q),f(d)\rangle/\tau)},

T4 から得られた 50万件の検索 triplet と 10万件の分類 triplet のキュレーション済み混合データに対して学習されます。初期化は 0.6B、4B、8B スケールの Qwen3-Embedding から行われます。同一のバックボーンが下流タスクの両方に使用される embedding を生成します:分類はクラス名クエリに対する最近傍プロトタイプ検索として実装され、検索はクエリと行の直接スコアリングとして実装されます。

結果

TabBench において、TabEmbed はすべてのスケールで競合するテキスト embedder を凌駕しています(表1)。0.6B では、Overall スコアが 44.92(Qwen3-Embedding-0.6B)から 65.27 に向上し、検索 nDCG@10 は 30.56 から 65.64 へと2倍以上になっています。4B では、Overall が 48.91 から 70.71 に、nDCG@10 が 35.76 から 74.25 に上昇しています。8B では、TabEmbed が Overall 71.62、MRR@10 80.58、nDCG@10 75.83 を達成し、Qwen3-Embedding-8B(48.03 / 40.06 / 34.16)および GTE-Qwen2-7B-Instruct(Overall 51.27)などの 7B クラスのベースラインを約20絶対ポイント上回っています。分類精度の向上は小さいものの一貫しており、0.6B で 67.16 対 62.81、8B で 69.88 対 65.08 となっています。これはテキスト embedder がすでに粗いクラス割り当てにある程度有能であったが、構造的制約の下での行検索において著しく劣っていたことを示唆しています。

0.6B バックボーンでの詳細な検索分析が最も診断的です。クエリをモダリティ別に層別化すると、TabEmbed は Categorical で平均 nDCG@10 84.61、Mixed で 65.96、Numeric で 46.37 を達成しており、Numeric バケットでベースラインに対する最大の絶対的な改善が見られます。これはまさにテキスト embedder が数値の大小を無視することが知られている箇所です。Numeric 設定において論理的制約の数が1から3に増えるにつれてパフォーマンスは単調に低下しますが、TabEmbed の低下はベースラインより緩やかであり、対照学習目標が単なるキーワードの重複だけでなく複数条件の交差に対する組み合わせ的な感度をある程度誘導することを示しています。

限界と未解決の問題

このベンチマークは標準的な embedder のコンテキストウィンドウに収まる行にのみ評価を限定しており、狭いテーブルに偏っています;非常に幅広いテーブルと複数行の推論はスコープ外です。Numeric 検索は改善されているものの、平均 nDCG@10 は依然として 46.37 に留まっており、モデルが連続的な大小関係の推論を解決したとは明らかに言えず、3制約 Numeric クエリの絶対性能が最も弱い点です。自己教師あり目標選択パイプラインは経験則(識別子やタイムスタンプのフィルタリング)に依存しており、その感度はアブレーションされていません。Triplet の比率(検索対分類 = 5:1)やハード負例マイニングのポリシーも提供されたセクションではアブレーションされておらず、共通のプローブにおける表形式特化エンコーダ(TabPFN、TabTransformer)との比較もなく、汎用テキスト embedder との比較のみです。また、4B から 8B への改善は僅か(Overall 70.71 から 71.62)であり、現在の 60万 triplet 学習予算の下での飽和を示唆しています。

なぜ重要か

TabEmbed は、マスクされたシリアライズ行に対する合成自然言語クエリを用いた単一の対照学習目標が、表形式特化のアーキテクチャなしに汎用テキスト embedder との 20 ポイントのギャップを埋め、表形式分類と検索の両方に同時に有用な embedding を生成できることを示しています。これによりテーブルのコンテンツが検索および RAG パイプラインにおいて直接ファーストクラスの市民として扱われるようになり、TabBench は行 embedding における数値的・構造的感度を測定するための具体的な目標をコミュニティに提供しています。

Source: https://arxiv.org/abs/2605.04962

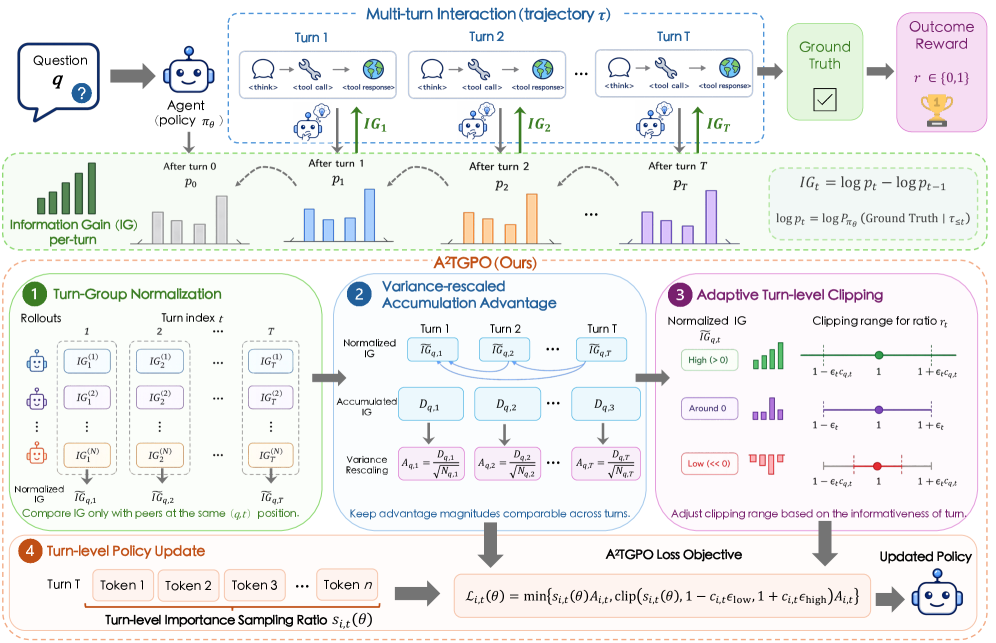

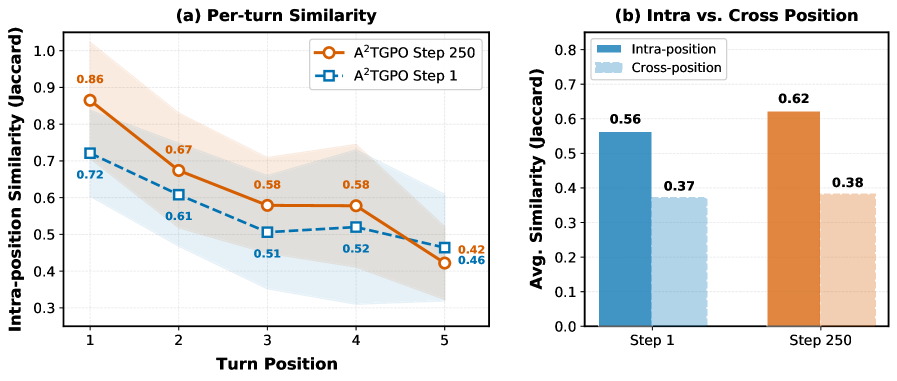

A^2TGPO: Agentic Turn-Group Policy Optimization with Adaptive Turn-level Clipping

問題

ツール使用エージェント型LLMをRLで学習する場合、報酬は通常トラジェクトリレベル(最終回答の正確さ)でのみ与えられるため、個々のツール呼び出しにわたるクレジットアサインメント問題が未解決のまま残ります。外部のプロセス報酬モデルは推論コストと独立した失敗モードを追加し、木構造ロールアウトは結果報酬を再分配するだけでトラジェクトリの多様性を制限します。より安価な代替手段がInformation Gain(IG)であり、これは各ターンにおけるポリシーの正解確率の予測変化量として定義されます。IGPOはこのシグナルを直接使用しますが、著者らはIGをGRPOスタイルのlossに組み込んだ際の3つの具体的な失敗モードを特定しています。

- 位置的コンテキストの不均一性。 全ターンにわたるプールされた正規化は、初期ターン(疎な証拠)と後期ターン(豊富なツールコンテキスト)を混合します。それらのIG分布は平均とスケールの両方において異なるため、合同でzスコア化すると相対的な順位が歪みます。

- 深さ依存のadvantageドリフト。 可変数のIG項を合計することで、advantageの大きさがトラジェクトリの長さに応じてスケールします。

- 均一なclipping。 単一のPPO clip \epsilon は、IGの大きさが大きく異なるターンを同一に扱います。

手法

A^2TGPOは各失敗モードを独立したコンポーネントで対処し、それらすべてがターンレベルのclippedポリシーlossに入力されます。

1. Turn-Group Normalization。 プロンプト q とターンインデックス t ごとに、G ロールアウト全体にわたるピアグループを以下のように定義します。

\mathcal{G}_{q,t} = \{\mathrm{ig}_{i,t} : i=1,\dots,G,\; t \le T_i\},

そしてこのグループ内でzスコア正規化を行います。

\widehat{\mathrm{ig}}_{i,t} = \frac{\mathrm{ig}_{i,t} - \mathrm{mean}(\mathcal{G}_{q,t})}{\mathrm{std}(\mathcal{G}_{q,t})}.

すでに終了したロールアウトは寄与せず、|\mathcal{G}_{q,t}| \le 1 の場合はIG項がゼロにされ、そのターンは結果報酬のみで駆動されます。その根拠は経験的なもので、同一プロンプトの同一ターンインデックスにおけるロールアウトは、異なるターンインデックスのものよりもコンテキストの重複が実質的に大きいため、(q,t)グルーピングは「この位置における良いツール呼び出しとは何か」を分離し、位置的レジームシフトとの混同を防ぎます。

2. 分散リスケーリングを伴う割引累積。 残りの \widehat{\mathrm{ig}} 値をそのまま合計する(分散が深さに応じて増大する)のではなく、A^2TGPOは割引累積を行い、有効項数 D_t でリスケーリングすることで、大きさが T_i に応じてドリフトしないターンレベルのadvantage \widehat{A}_{i,t} を得ます。結果報酬は同じ再帰の終端寄与として組み込まれます。

3. Adaptive turn-level clipping。 clip半幅を(正規化された)IGの大きさのsigmapマッピングによりターン固有にします。

c_{i,t} = \sigma(\cdot)\,\epsilon,

これにより、強い情報量を持つIGシグナルを持つターンにはより大きなトラストリージョン更新が許容され、情報量が少ないまたはノイズの多いターンはより厳しくclippingされます。\widehat{A}_{i,t} と c_{i,t} の両方が標準的なPPOスタイルのターンレベルclipped目的関数に入力されます。

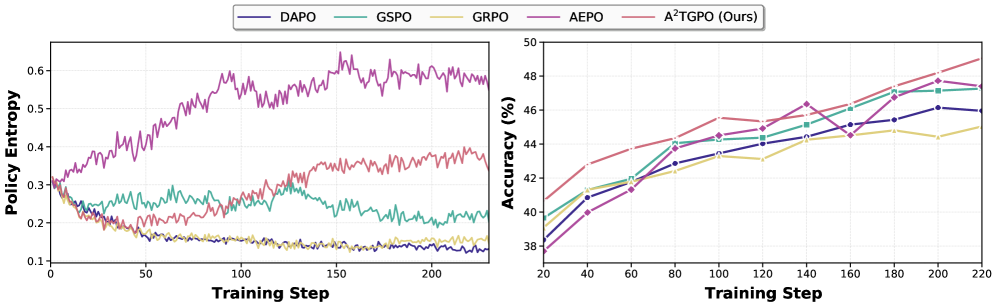

結果

評価はSearch-R1検索環境を使用し、7つのオープンドメインQAベンチマーク(マルチホップ: HotpotQA、2Wiki、MuSiQue、Bamboogle;シングルホップ: NQ、TriviaQA、PopQA)において、Qwen3-4B、Qwen3-8B、Qwen2.5-7Bを対象にEMを指標として行われます。

Qwen3-4Bにおいて、A^2TGPOはマルチホップで平均EM 48.06(AEPOの46.96、GRPOの46.02、IGPOの44.88と比較)、シングルホップで56.44(DAPOの56.33と比較)に達します。Qwen3-8Bでは、マルチホップ平均が48.85(DAPOの47.96、IGPOの47.07と比較)、シングルホップが57.54(DAPOの57.14と比較)です。最大の改善はQwen2.5-7Bで見られ、マルチホップ45.75対最強ベースラインDAPOの43.54、シングルホップ56.25対54.70です。Qwen2.5-7BのMuSiQueにおいて、本手法はEM 23.63に達し、IGPOの20.66やGRPOの19.97に対して、最も難しいマルチホップセットで大きな改善を示します。Tree-GRPOはQwen3での学習の不安定性のためQwen2.5-7Bのみで報告されており、そこではGRPOさえも下回っています(マルチホップ平均38.44)。

Qwen3-4Bのマルチホップにおけるアブレーションは各コンポーネントの寄与を分離しています:IGPOベースライン44.88、+TG-Norm 46.27、+TG-Norm+D_tリスケーリング 46.71、そして完全な手法(adaptive clippingを追加)で48.06に達します。3つのコンポーネントそれぞれが約1ポイントの寄与をしており、正規化が最大の単一の改善源です。

学習エントロピー曲線は、A^2TGPOが学習全体を通じてGRPO/IGPOよりも高い探索エントロピーを維持しながら、より高いEMに収束することを示しており、adaptive clippingが低IGターンでの早期崩壊を防ぐという主張と整合しています。

限界と未解決の問題

IGは正解の答えの確率に対して計算されるため、この手法は検証可能なターゲット文字列を持つタスクに限定されます。オープンエンドな生成への拡張には異なる内在的シグナルが必要です。(q,t) ピアグループは t が大きくなるにつれて縮小し、|\mathcal{G}_{q,t}|\le 1 の場合は論文が結果のみにフォールバックします;多くのロールアウトが長さで発散する長ホライズンのエージェントタスクでは、このレジームに頻繁に陥ることになります。sigmoidクリップスケジュールはハイパーパラメータを導入しますが、その感度は本文中で十分に特徴づけられていません。最後に、すべての結果は単一の検索ツール環境を使用しており、turn-group正規化の仮定(同一 t における異なるロールアウト間のコンテキスト類似性)が分岐状態を持つツールエコシステム(コード実行、ブラウジング)において成立するかどうかは未検証です。

なぜ重要か

A^2TGPOは、IGをGRPOに組み込む際の3つの(後から考えれば明らかな)欠陥——プールされた正規化、深さ依存のadvantageスケール、均一なclipping——がそれぞれ約1ポイントのEMを損なうことを明確に示しており、それらを修正することで、外部報酬モデルや木構造ロールアウトなしにDAPO/GSPO/IGPO/AEPOを上回るプロセス教師ありエージェントRLレシピが得られることを実証しています。ツール統合RVLRパイプラインへの実用的なドロップイン置換として機能します。

Source: https://arxiv.org/abs/2605.06200

Hacker News Signals

自然言語オートエンコーダ:Claudeの思考をテキストに変換する

Anthropicは、拡張思考モデルが生成する内部的な chain-of-thought(CoT)表現を読み取り可能な自然言語サマリーに変換し、そのサマリーからモデルのその後の振る舞いを再構成する技術について解説しています。このシステムはオートエンコーダとして訓練されており、エンコーダモデルが内部推論トークンのシーケンスを自然言語の「サマリー」文字列に圧縮し、デコーダモデルがその文字列を条件として元のモデルの下流出力を再現する仕組みになっています。

主要な技術的課題は、拡張思考トレースが長く、潜在的であり、必ずしも人間が読み解きやすいものではないという点です。これらのトレースには、曖昧な表現、繰り返し、そして散文に直接対応しない暗黙的な状態が含まれています。オートエンコーダは再構成目的関数を用いてエンドツーエンドで訓練されます。すなわち、元のタスクと自然言語サマリー(ただし元のトレースは与えない)が与えられたとき、デコーダは元のモデルが生成するであろう出力と統計的に区別のつかない回答を生成すべきとされています。忠実度はトークンレベルの類似性ではなく、出力分布の比較によって測定されます。

実践的な動機は解釈可能性と監視にあります。推論を自然言語の記述に忠実に圧縮できれば、人間または監視モデルが数千トークンを読むことなく内容を確認できます。Anthropicは、サマリーが人間に読みやすく、かつ再現のために情報的に十分であるかどうかを検証しています。その結果、圧縮レベルが高まるにつれて再構成精度は緩やかに低下し、特に多段階の算術演算やバックトラッキングを含む推論クラスは損失なく要約することが難しいと報告されています。

未解決の問題としては、サマリーが誠実な表現なのか事後的な合理化なのかという点があります(エンコーダは、振る舞いに重要であっても言語化が難しい特徴を省略するよう学習してしまう可能性があります)。また、このアプローチがより長いトレースや複雑なタスクにスケールするかどうかも不明です。さらに、この手法は「振る舞いの再現」が適切な忠実度指標であることを前提としていますが、安全性に関わる推論において重要となり得る潜在的な状態を見逃す可能性もあります。

Source: https://www.anthropic.com/research/natural-language-autoencoders

Gemma 4の高速化:Multi-Token Prediction Drafterによる推論の効率化

Googleは、メインモデルと同時に学習させた小規模なmulti-token prediction(MTP)draft headを用いたspeculative decodingをGemma 4に展開したことを報告しています。このアーキテクチャでは、軽量なdraftモジュール——実質的には中間層に接続された浅いfeedforwardプロジェクタ——を追加し、現在のhidden stateが与えられた条件のもとで次のk個のトークンを並列に予測します。その後、メインモデルがk個のdraftトークンすべてを単一のforward passで検証し、メインモデルの分布と一致するトークンは採用され、最初の不一致が生じた時点でロールバックが発生します。

スピードアップの効果はacceptance rateによって決まります。採用率はdraft分布q(x_{t+1}|x_{1:t})がメインモデルの分布p(x_{t+1}|x_{1:t})をどの程度追跡できるかに依存します。Googleはk=4のdraftを用いた典型的なテキスト生成タスクにおいて、acceptance rateが約80〜85%であると報告しており、出力分布を変えることなく約2〜3倍のスループット向上が得られています。speculative decodingはrejection samplingによって構造上厳密であることが保証されています。

これを標準的なspeculative decoding(draftモデルとして別の小さなモデルを使用する方式)と区別する点は、co-trainingにあります。MTP headはメインモデルのresidual streamを共有し、共同で学習されるため、検証器が使用するのと同じ表現を参照できます。これにより、独立した小さなモデルをdrafterとして使用する場合と比較して分布のギャップが縮小し、acceptance rateが向上します。draft headがモデル全体のサイズに対して追加するパラメータのオーバーヘッドは最小限です。

推論インフラの観点からは、このアプローチでは別途draftモデルのpassを実行するための追加メモリ帯域幅が不要です。draft headは学習中にメインモデルのforward passに相乗りし、推論時にはキャッシュされたactivationを用いて先行して実行されます。この記事では、この機能がHugging Face上のGemma 4 27Bリリースで利用可能になっており、標準的なvLLMスタイルのエンジンと互換性があることが報告されています。

制限事項として、acceptance rateはタスクに依存し、高度にランダムな出力や敵対的な出力においては低下します。また、co-trainingのコストを要するため、学習済みチェックポイントにMTP headを後付けする場合は、単に接続するだけでなくfine-tuningが必要になります。

Source: https://blog.google/innovation-and-ai/technology/developers-tools/multi-token-prediction-gemma-4/

拡散モデルの積分を学習する

Sander Dieleman の記事は「flow map」という概念を展開しています。これは、瞬時的なスコアや速度場を学習するのではなく、確率流 ODE の積分を直接学習するというアイデアです。標準的な拡散/flow-matching モデルは v_\theta(x_t, t) を学習して dx = v_\theta\, dt を満たすようにし、多数の NFE(number of function evaluations)を用いて数値的に積分します。一方、flow map のアイデアは F_\theta(x_s, s, t) を学習して x_t = F_\theta(x_s, s, t) が直接成り立つようにするもので、時刻 s におけるノイズ付きサンプルを時刻 t における対応する点へと一度の評価でマッピングします。

consistency model との関係は明示的です。consistency model は一方のエンドポイントが常にデータ分布(t=0)である特殊ケースであり、x_0 = F_\theta(x_s, s, 0) となります。flow map はこれを任意の (s,t) ペアへと一般化し、自己整合性条件 F_\theta(F_\theta(x_r, r, s), s, t) = F_\theta(x_r, r, t)(すべての r < s < t に対して)を満たす必要があります。これは真の確率流の半群性質に類比されます。

学習ではこの半群制約を consistency loss として活用します。consistency training に似ていますが、一方のエンドポイントを固定しない点が異なります。記事はこのフレームワークが、consistency model、学習済み積分器を用いた flow matching、および shortcut model(可変ステップのジャンプを学習するもの)を共通の数学的枠組みの下で統一するものだと主張しています。

実用的には、学習済みの flow map は純粋なノイズ(t=T)からデータ(t=0)へと直接ジャンプすることで、1 回または 2 回の NFE でサンプルを生成でき、パラメータ化がより表現力豊かであるため consistency model よりも高品質になる可能性があります。記事は主に概念的なものですが、学習目標の概略や先行研究(EDM、CM、Shortcut Models、TRACT)との接続についても触れています。

未解決の問題:学習中に半群性質を近似的に強制することを、モード崩壊や学習の不安定性なしに実現することはまだ解決されておらず、記事はここが困難なエンジニアリング作業の核心であると認めています。

Source: https://sander.ai/2026/05/06/flow-maps.html

AlphaEvolve: Gemini搭載コーディングエージェントが各分野にスケールするインパクト

DeepMindによるAlphaEvolveのフォローアップ記事では、元々の行列乗算とソーティングネットワークの発見を超えた新たな応用結果が詳述されています。システムアーキテクチャは、コードを生成するプロポーザーとしてGeminiモデルを採用し、提案されたプログラムを実行してハードな目的関数に対してスコアリングする自動評価器と組み合わせています。進化はquality-diversity searchとして実装されており、プログラムの変種からなる集団が維持され、LLMはfitness(適合度)に基づいて選別された高スコアの例をコンテキストとしてプロンプトに与えられます(fitnessByガイドされたfew-shotのin-context learningに類似しています)。

報告された新たな結果には、Googleの内部データセンタースケジューリングに使用されているbin packingヒューリスティクスの改善(フリートスケールでのハードウェア無駄を0.7%削減したと主張)、TPUカーネルに関連する特定サイズ向けのFFTライクな変換の高速化、および複数次元におけるkissing numberの下限の改善(以前の記録が数十年間破られていなかった組合せ論の問題)が含まれています。kissing numberの結果は特筆すべきで、単に微分可能なメトリクスを最適化するのではなく、構造化された数学的オブジェクトである明示的な球充填を発見する必要があるためです。

重要な技術的ポイントは、AlphaEvolveが探索空間のモデルを学習するのではなく、LLMをプログラムテキスト上のmutation/crossover演算子として使用し、fitness評価のみを学習シグナルとして用いる点です。これにより、離散的な組合せ構造を扱いながら、微分可能な目的関数の必要性を回避しています。その代償として、各評価を数千回実行できるほど安価にする必要があります。

認められている限界として、システムはfitness関数が正確で、高速かつ決定論的である場合に最もよく機能します。長いロールアウト、人間による評価、または確率的な環境を必要とするタスクはより困難です。また、LLMプロポーザーは標準的なバイアスを引き継いでおり、真に新規なアルゴリズムアイデアよりも、よく表現されているコードパターンの変形を提案する方が得意です。

Source: https://deepmind.google/blog/alphaevolve-impact/

ディープラーニングの理論

この投稿は、深層ネットワークがなぜ汎化するのか、そして何を計算しているのかについて、統一的な理論的説明を試みるものです。中心的な主張は近似理論の観点から導かれています。すなわち、深層ネットワークは合成的構造を持つ関数の効率的な表現であり、そのような関数に対して、浅いネットワークと比較した場合に深さが表現効率において指数的な利得をもたらすというものです――この点は、2014年から2016年に遡るMontufar et al.やTelgarskyの結果のような定理によって形式化されています。

この投稿はいくつかのテーマを統合しています。すなわち、フラットな極小点へのSGDの implicit bias とPAC-Bayes汎化bound との関係(フラットな極小点は短い記述長・低い複雑性に対応する)、ネットワークがカーネル機械のように振る舞う極限ケースとしてのneural tangent kernel(NTK)レジームとその実際の学習ダイナミクスへの非代表性、そして、ニューロンが初期化から大きく移動し固定カーネルでは捉えられない内部表現をネットワークが発達させるfeature learningレジームです。

double-descentの現象――補間閾値を超えた後に汎化誤差が再び減少すること――についても論じられており、古典的なバイアス・分散トレードオフではなく、過パラメータ化とgradient descentによって課せられる implicit regularizationの観点から説明されています。最小ノルム補間との関連についても言及されています。

この投稿は、新しい結果を提示するというよりも、上級大学院生を対象とした整理のとれた総合的解説として読めます。lottery ticket仮説、grokking(遅延汎化)、mechanistic interpretabilityを、現在の理論的ツールキットでは部分的にしか対処できない未解決現象として取り上げています。

この投稿自体の主な限界は、証明ではなく総合的解説であるという点です――多くの「説明」は推測または現象論的記述に留まります。制限された設定(線形ネットワーク、NTKレジーム、無限幅)において証明された定理と、有限幅・有限データのtransformerにおける実証的実践との間のギャップは、この投稿が閉じることのできない中心的未解決問題として残っています。

Source: https://elonlit.com/scrivings/a-theory-of-deep-learning/

注目の新しいリポジトリ

Tencent-Hunyuan/HY-World-2.0

HY-World 2.0 は、3つの密接に関連するタスク——単眼または疎視点入力からの3Dシーン再構成、新規視点合成、および動的3D環境の順方向シミュレーション——を対象としたマルチモーダル世界モデルです。アーキテクチャは、video diffusion バックボーンと空間認識型conditioning機構を組み合わせており、各denoising ステップにおいて幾何学的事前情報(深度、表面法線、カメラポーズ embedding)を注入することで、明示的なボクセルやNeRF表現を必要とせず、生成フレーム間での3D一貫性を維持します。シミュレーション部は、アクションまたは物理トークンを条件として生成パイプラインを拡張することで、もっともらしいシーンダイナミクスのロールアウトを可能にします。マルチモーダルという側面は、テキスト・画像・点群プロンプトへの同時conditioning を指しており、これらはすべてモダリティ固有のエンコーダを介して共有潜在空間に投影されます。学習には階層的な目標関数が用いられており、既知視点に対するreconstruction loss、合成視点に対するperceptual loss、およびシミュレートされたフレーム間のtemporal consistency 正則化項が含まれます。リポジトリには、事前学習済みチェックポイント、推論スクリプト、およびデータセット前処理パイプラインが含まれています。注目すべき設計上の選択として、本モデルはシーン幾何推定と外観生成を切り離し、予測された幾何学情報を hard constraint として供給することで、diffusion モデルが構造を自由にハルシネートすることを防いでいます。これにより、長期的なシミュレーションにおける幾何学的ドリフトが軽減されます。ただし、まだ初期段階にあり、複雑な遮蔽ダイナミクスを含むシーンではシミュレーションの忠実度が低下し、非常に大規模な屋外環境におけるスケーリング挙動はまだ特性が明らかにされていません。

Source: https://github.com/Tencent-Hunyuan/HY-World-2.0

walkinglabs/hands-on-modern-rl

表形式RLから現代的なLLMアライメント技術までのフルスタックをカバーする、体系的なカリキュラムリポジトリです。内容は段階的なモジュールで構成されており、まず古典的なアルゴリズム(Q-learning、policy gradient、PPO、SAC)をPyTorchでゼロから実装するモジュールが用意され、続いてRLHF、direct preference optimization(DPO)、reinforcement learning from verifiable rewards(RLVR)に関するモジュールが続きます。各モジュールは、理論的な解説と実行可能なJupyter notebookをペアにしており、カスタムのGridWorldバリアントや軽量な言語タスクを含む、小規模ながら非自明な環境を対象としています。RLVRのセクションは特に具体的で、結果の正しさに基づくシグナル(数学の問題の解答、コードの実行結果)で学習したreward modelを実装し、それを用いて小規模な因果言語モデルをPPOでfine-tuningすることで、DeepSeek-R1のような系統のシステムの基本的なループを再現しています。エージェント型システムのセクションでは、tool-useのfine-tuning、ReActスタイルのprompting、および共有value functionを用いたマルチエージェント協調を取り上げています。コードの依存関係は最小限に抑えられており、NumPy、PyTorch、Hugging Face Transformers、およびtrlのみを使用します。このカリキュラムは明示的に自己完結型として設計されており、各notebookはコンシューマ向けの単一のGPU上で実行可能です。制限事項として、LLMスケールの実験では小規模なプロキシモデル(1〜3Bパラメータ)を使用しているため、このカリキュラムは最先端のアライメント性能を再現するものではなく、仕組みを説明することを目的としています。また、分散学習のサポートは含まれておらず、スケーラビリティの直接的な検証には限界があります。

Source: https://github.com/walkinglabs/hands-on-modern-rl

future-agi/future-agi

LLMアプリケーションおよびAIエージェント向けのエンドツーエンドのオブザーバビリティ・評価プラットフォームで、Apache 2.0ライセンスのもとセルフホスト可能です。主要な技術コンポーネントは以下の通りです:(1) OpenTelemetry互換のスパンを通じてLLMの呼び出しやエージェントのステップを計測するトレーシング層で、レイテンシ・トークン数・プロンプト/コンプリーションのペイロード・ツール呼び出しを構造化ログストアにキャプチャします;(2) 参照ベースのメトリクス(完全一致、ROUGE、embedding類似度)と、設定可能なジャッジモデルがカスタムルーブリックに基づいて出力をスコアリングするLLM-as-judgeパイプラインの両方をサポートする評価エンジン;(3) 記録されたトレースを変更済みプロンプトまたはモデルバージョンに対して再実行し、反事実的な品質差分を推定するシミュレーションモジュール;(4) 評価セットのバージョン管理のためのデータセット管理層;(5) 統合されたレート制限とコスト追跡を備え、複数のプロバイダ(OpenAI、Anthropicなど)へのリクエストをプロキシするLLM gateway;(6) 設定可能なポリシールールを用いたランタイムコンテンツフィルタリングのためのガードレールコンポーネント。このアーキテクチャはデータプレーン(トレースの取り込みと保存)をコントロールプレーン(eval スケジューリング、ダッシュボードサービング)から分離しており、UIとは独立して取り込みの水平スケーリングを可能にしています。セルフホスティングはDocker Composeベースで、構造化データにはPostgres、アーティファクトのblobにはオプションでS3互換ストレージを使用します。このプラットフォームは、オフラインのベンチマーク数値では不十分であり、リクエストごとの挙動の可視性が求められる本番環境のデバッグワークフローを対象としています。

Source: https://github.com/future-agi/future-agi

facebookresearch/neuroai

電気生理学、カルシウムイメージング、fMRI、行動データのモダリティにわたる神経科学とAIの融合研究向けに、統一インターフェースを提供するPythonライブラリです。コアの抽象化として、異種記録フォーマット(NWB、HDF5、生バイナリ)を処理し、PyTorchモデルへの直接入力に適した標準化されたtrial-alignedテンソルを公開する、モダリティに依存しない NeuralDataset クラスを採用しています。組み込みの前処理パイプラインは、スパイクソーティングの統合、dF/F抽出、血行動態応答のデコンボリューション、刺激アライメントをカバーしており、それぞれパラメータ化されており組み合わせて使用できます。このライブラリには、神経集団の幾何構造をDNNの層の活性化と比較するために設計された表現解析ツールのスイートが含まれており、centered kernel alignment(CKA)、representational dissimilarity matrices(RDMs)、および線形デコーディングprobeが提供されています。モデルズーコンポーネントは、複数の公開データセット(NSD、Allen Brain Observatory)にわたって視覚刺激を神経応答にマッピングする、事前学習済みencoding model(線形および非線形)を提供しています。アーキテクチャはモジュール式で、データ読み込み、前処理、解析、モデリングはモノレポ内の独立したパッケージとして構成されています。このライブラリは初期段階にあり(執筆時点で143スター)、現在は視覚神経科学に対するカバレッジが最も充実しています。同一被験者からの電気生理学とfMRIのようなクロスモーダル統合はロードマップに記載されていますが、未実装です。多領域大規模記録における実用的な課題として、GPUアクセラレーテッドなスパイクソーティング統合が欠如している点が挙げられます。

Source: https://github.com/facebookresearch/neuroai

kyegomez/OpenMythos

AnthropicのClaudeモデル(“Claude Mythos”)の背後にあるアーキテクチャ上の仮説を、公開されている文献・技術レポート・ブログ記事から再構築しようとする、思索的なリバースエンジニアリングの試みです。このリポジトリには、著者が推測した設計上の判断をPyTorchの擬似コードとして実装したものが含まれています。具体的には、自己批評ループを伴うConstitutional AI方式のRLHF、観測された能力対FLOPスケーリングと整合するエキスパートルーティングを仮定したmixture-of-experts transformer バックボーン、特定のhead数比を持つmulti-query attention、そしてClaudeの長文コンテキスト性能を説明するために仮定された階層的コンテキストウィンドウ機構が含まれます。この「再構築」はあくまで理論的なものであり、重みは提供されておらず、Claudeの実際の出力に対する実証的な検証も行われていません。コードの品質は一貫しておらず、完全なforward passの実装が行われているモジュールもあれば、TODOコメントが残った骨格だけのスタブもあります。Constitutional自己批評モジュールが最も充実したセクションであり、AnthropicのConstitutional AI論文(Bai et al., 2022)で説明されているgenerate-critique-reviseループを、設定可能な原則セットとともに実装しています。スター数が12,000以上と多いのは、検証済みの技術的内容によるものではなく、Claudeの内部構造に対するコミュニティの関心を反映しています。このリポジトリの主な実用的価値は、構造化された参考文献リストおよび仮説カタログとしての役割にあり、READMEでは各アーキテクチャ上の主張がその引用元にマッピングされています。アーキテクチャに関するすべての主張は未検証の推測として扱ってください。Anthropicによって確認されたものは一切ありません。